Einen Roboter haben Sie wie eines seiner französischen Mädchen malen

Sicher, gestengesteuerte Roboter sind cool. Noch Cooler? Wissenschaftler haben eine Möglichkeit zur Steuerung eines Roboterarms nur durch Blinken dabei entwickelt – ohne Hände benötigt.

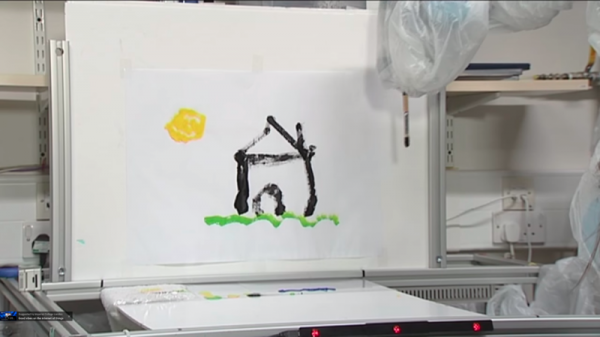

Forscher am Imperial College London demonstriert dies dadurch, dass ein menschlicher Kontrolle einen Roboterarm, ein Bild zu malen, indem Sie nur ihre Augenbewegungen während sie eine Croissant aß und einen Kaffee getrunken.

Sabine Dziemian, post-graduate Student aus der Demonstration, beschreibt Steuerung den Arm als "intuitiv und einfach" Erlebnis.

Um welche Farbe kennzeichnen sie verwenden will, lenkt sie ihre Augen und blinkt. Der Roboter taucht seinen Pinsel und malt Striche, wie sie es mit ihren Augen leitet. Ändern Sie Farben, She blinkt drei Mal eine andere Farbe zu betrachten. Ein weiterer drei blinkt gibt den Pinsel auf die Leinwand zurück.

Das letzte Bild sieht aus wie etwas, was einem fünf Jahre alten schaffen würde. Diese rudimentäre Experiment ist jedoch nur der Anfang.

Die meiste Zeit, wenn wir ein Glas abholen wollen, schauen wir uns es zu beurteilen, seine Größe, Abstand von uns und wie bilden wir unsere Griff, um ihn abzuholen. Aber Roboter haben nicht die gleichen peripheren Sinn als uns.

Dr. Aldo Faisal, einer der Forscher, sagt, dass sie auf dieser sechs Jahre lang gearbeitet haben jetzt, um Systeme zu entwickeln, die unsere Absicht des Handelns von unsere Augenbewegungen zu entschlüsseln. Algorithmen zu entwickeln, die unsere Augenbewegungen zu nehmen und sie in Aktionen umzusetzen.

Faisal sagt, dass der nächste Schritt ist, um den ganzen Körper des Roboters mit Augenbewegungen zu steuern, so dass jeder kann Multi-Task.

"Stellen Sie sich vor, zum Beispiel, dass Sie malen und Essen und zur gleichen Zeit trinken, vorstellen, hält ein Baby und sein Essen zubereiten, während Sie es tun alle gleichzeitig. So gibt es ganz neue Möglichkeiten, wie, die wir denken können, über die Interaktion mit der Welt", sagte Faisal Reuters.

Dies ist nicht die einzige Roboterprojekt arbeite Augensteuerung. Früher in diesem Sommer, demonstrierte Programmierer Gal Sont, wie man einen Telepresence-Roboter bewegen und machen es nur mit Augenbewegungen zu sprechen.

Gal Sont, Programmierer, leidet an ALS. Die Software erlaubt es ihm, gehen draußen und bequem mit Menschen über den Roboter unterhalten – etwas, das nicht alle ALS-Patienten die Möglichkeit haben, – gibt ihm zurück einige der die Freiheit die Krankheit nahm.

Diese Technologie könnte besonders praktisch für Menschen, die leiden schwächenden Erkrankungen wie Multiple Sklerose oder Parkinson benimmt sich wie ein zusätzliches Paar Hände und Arme.

Bleibt zu hoffen, dass Roboter nicht lernen, was wir durch unsere Augenbewegungen denken zu entschlüsseln.

Bild via Imperial College London/YouTube