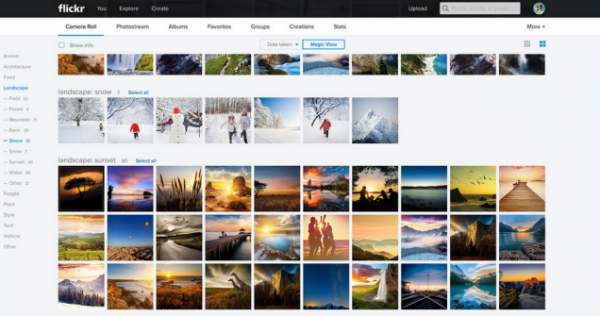

Flickr Bild-Erkennungs-Tool macht einige peinliche Fehler

Nun, das ist peinlich. Flickr ist scheinbar beeindruckende Bilderkennungssystem macht einige peinliche Ausrutscher beim Identifizieren von Menschen mit schwarzer Hautfarbe und Konzentrationslagern, laut dem Guardian.

Die Zeitung erklärt, dass der neue Algorithmus, die entworfen, um markieren und filtern dann Bilder von Inhalt, "häufig Zündaussetzer ist." Es beschreibt, wie ein Porträt von einem schwarzen Mann namens William Auto gekennzeichnet als "Blackandwhite" und "Monochrom" zusammen mit "Tier" und "Affe." bekam (Übrigens, habe ein Bild von einer weißen Frau auch die gleiche Behandlung.) An anderer Stelle, wurde Bilder des Konzentrationslagers Dachau wurden mit dem Stichwort "Jungle Gym" und "Sport", während man von Auschwitz auch als Darstellung "Sport."

Aber es lohnt sich, darauf hinzuweisen, dass solche Fehler natürlich sind – und nützlich. Flickr verwendet einen lernfähige Ansatz, um Bilder, zu identifizieren, um diejenigen, die es, in der Vergangenheit versuchen zu erkennen gesehen hat, was sie zeigen neue Bilder zu vergleichen. Infolgedessen wird nicht es immer erhalten sie Recht, so ist ein wichtiger Schritt für die Nutzer, unangemessene Tags zu löschen, so dass sie aus ihren Fehlern lernen kann. In anderen Worten, kann es schneller lernen, indem Sie ein paar Fehler zu machen und dann korrigieren.

Also, ja, sind die Zettel, die Flickr Algorithmus vorgenommen hat peinlich. Aber sie werden auch in Zukunft weniger umständlich zu machen. [Wächter]