Gefühl neidisch oder lustvollen? Gehirn-Scans kann sagen

In den letzten Sprung des Gedankenlesen sagen Wissenschaftler, dass sie in der Lage, eine Person, die Emotionen durch Gehirn-Scans zu entziffern waren.

Muster der neuronalen Aktivität können verschenken was Menschen denken und fühlen, sind, wenn Wissenschaftler Bedeutung von Gehirn-Scans durch funktionelle Kernspintomographie (fMRI) erhalten können. In vergangenen Studien, Forscher haben gezeigt, dass sie bestimmen können, welche Zahl von eine Person denkt, Vorhersagen, wo Menschen stehen in einer virtual-Reality-Umgebung, und selbst herausfinden, was für ein Mensch ist träumen, alle mit Blick auf Gehirn-Scans.

In der neuen Studie untersuchten Forscher an der Carnegie Mellon University, wo Wut, Abscheu, Neid, Angst, Glück, Lust, stolz, Trauer und Scham im Gehirn Leben. Um zu gewährleisten, dass die Teilnehmer der Studie in der Lage wäre, zuverlässig und immer wieder diese Emotionen zu beschwören, wurden 10 Methode Akteure aus der Schule am Drama Department rekrutiert. [Bildergalerie: schneidet durch das Gehirn]

"sie sind wirklich gut darin, sich in diese emotionalen Zustände" Autor der Studie Karim Kassam in einem Video von Carnegie Mellon sagte. Die Schauspieler wurden angewiesen, um Szenarien für jede Emotion zu schreiben, so dass sie auf ein Stichwort in die richtige Stimmung schlüpfen konnte, liegend in einem fMRI-Maschine.

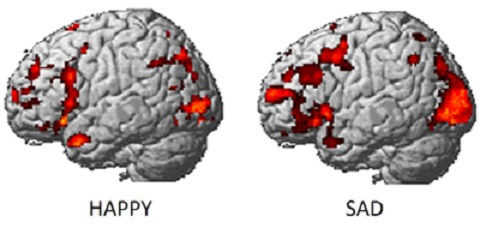

Mit Blick auf die Hirnaktivität von den Schauspielern, fanden die Forscher gab es neuronale Signaturen jeweils Gefühlszustand zugeordnet, und, dass diese Signaturen für Einzelpersonen freigegeben wurden.

"Trotz offensichtlicher Unterschiede zwischen Menschen Psychologie, tendenziell unterschiedliche Menschen Neural Emotionen in auffallend ähnlicher Weise kodieren" Doktorandin und Forscher, die Amanda Markey in einer Erklärung sagte zu studieren.

Ein Computermodell, das die Gehirn-Muster mit den Akteuren selbst herbeigeführten Emotionen verbunden gelernt konnte schließlich erraten, welches Gefühl war mit einem hohen Grad an Genauigkeit hervorgerufen wird. Das Modell war am genauesten bei der Identifizierung von Glück und ungenaueste im Orten genau Neid. Es in der Regel nicht verwechseln, positive und negative Emotionen, sagten die Forscher.

Geilheit war selten für jede andere Emotion verwechselt, und Lust Muster der neuronalen Aktivität war nicht verbunden mit positiven oder negativen emotionalen Unterschriften, was darauf hindeutet, dass es auf eine ganz andere Klasse Gefühl gehören könnte.

Die Forscher waren besorgt, dass Emotionen wie Wut, wenn Sie von den Akteuren beschworen Wut spontan erlebt durch den Rest der Bevölkerung unterschiedlich sein würde. Um diese mögliche Ungleichheit im Zaum zu halten, entwickelt sie ein zweites Experiment in dem Teilnehmer nicht aufgefordert wurden, jede Emotion auf eigene Faust zu berufen, sondern stattdessen zeigten sie Bilder sollen ihnen Ekel.

Als die Akteure der widerlichen Bilder sah, vorausgesagt das Computermodell, dass sie Ekel 60 Prozent der Zeit erlebten, und Ekel unter die Top zwei Vorhersagen 80 Prozent der Zeit aufgeführten, fanden die Forscher.

Die Wissenschaftler sagten, dass sie überrascht waren, dass der Computer auch Emotion nur anhand der Aktivierungsmuster in einem Unterabschnitt des Gehirns vorhersagen könnte.

"Dies deutet darauf hin, dass Emotion Signaturen beschränken sich nicht auf bestimmte Gehirnregionen wie der Amygdala, aber charakteristische Muster während der Reihe von Hirnregionen, zu produzieren", sagte Vladimir Cherkassky, wissenschaftlicher Programmierer im Bereich Psychologie.

Neue Wege zur Emotion in Studien zu untersuchen, ohne dass auf Selbstauskunft, manchmal unzuverlässige Methode, verlassen die Scans eröffnen könnte, sagte der Wissenschaftler.

"Hiermit könnte Sie emotionale Reaktion eines Individuums auf fast jede Art von Reiz, z. B. eine Fahne, eine Marke oder einen politischen Kandidaten bewerten" sagte Kassam in einer Erklärung.

Die Ergebnisse wurden Mittwoch (19. Juni) in der Fachzeitschrift PLOS ONE veröffentlicht.

Folgen Sie Megan Gannon auf Twitter und Google +. Folgen Sie uns @livescience , Facebook & Google + .