Google will nicht versehentlich Skynet, machen, so dass es eine AI aus-Schalter ist die Schaffung

Es gibt zwei unverwechselbare Seiten zur Debatte über die Zukunft der künstlichen Intelligenz. In der Ecke "Boom" sind Unternehmen wie Google, Facebook, Amazon und Microsoft aggressiv investieren in Technologie KI Systeme intelligenter und klüger zu machen. Und in der Ecke "Doom" sind prominente Denker wie Elon Musk und Stephen Hawking, die gesagt haben, dass AI ist wie "den Dämon zu beschwören."

Nun, eines der die fortschrittlichste AI-Outfits, Google's DeepMind, ergreift Maßnahmen zur Sicherheit für den Fall, dass menschliche Operatoren müssen Sie "Steuerung eines Roboters, das Fehlverhalten ist, die zu irreversiblen Folgen führen können", ich nehme an, enthält aber beschränkt sich nicht auf alle Menschen zu töten. Allerdings geht dieses Papier nicht fast so apokalyptisch und hält Beispiele einfach, wie intelligente Roboter in einer Fabrik gearbeitet.

Das veröffentlichte Dokument wurde eine gemeinsame Anstrengung von Google DeepMind und der Universität Oxford Future of Humanity Institute, die wie der Name schon sagt, will es eine Zukunft für die Menschheit sein. Gründer und Geschäftsführer Nick Bostrom ist seit Jahrzehnten lautstark über die möglichen Gefahren der entwickelnden AI und hat ganze Bücher diskutieren die Auswirkungen von superintelligenten Robotern.

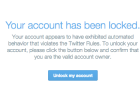

Diesem bestimmten Papier mit dem Titel "Sicher unterbrechbar Agents" untersucht, wie AI deaktiviert, wenn es anfängt, etwas zu tun, seine menschliche Operator nicht tun möchten. Das Papier ist voller Mathematik, die 99 Prozent von uns nie verstehen werde, die im Grunde Methoden beschreibt für den Aufbau des Papiers frech "großen roten Knopf" in AI nennt.

Die Forscher haben die gleichen Filme gesehen, die Sie haben. Sie wissen, das man wo die Roboter lernt , einen Turn-Off-Befehl ignorieren. Sie sind darauf vorbereitet.

Dieser Beitrag untersucht einen Weg, um sicherzustellen, dass ein lernen-Agent wird nicht lernen zu verhindern (oder suchen!), von der Umgebung oder einem menschlichen Operator unterbrochen.

Es mag übertrieben erscheinen, oder eine unnötige Einschränkung, wenn man bedenkt, dass die eindrucksvollste AI Leistung Menschheit je gesehen hat ist, dass es wirklich gut bei Brettspielen. Aber Bostrom hat die Theorie vor, die es dauert wirklich nur konstruieren eine menschliche Ebene AI um schnell Roboter Gehirne jenseits unserer eigenen katapultieren:

Künstliche Intelligenz menschlichen Ebene erreicht, wird eine positive Feedback-Schleife, die der Entwicklung einen weiteren Schub geben wird. AIs würde helfen, Bau besser AIs, was wiederum würde helfen, Gebäude besser AIs, und so weiter.

Sicher ist sicher.