Künstliche Soundeffekte haben jetzt Uncanny Valley eingegeben.

Mit maschinellem Lernen, haben Forscher vom MIT ein System entwickelt, das Sound-Effekte produziert, die sind so realistisch, dass sie sogar menschliche Zuhörer täuschen.

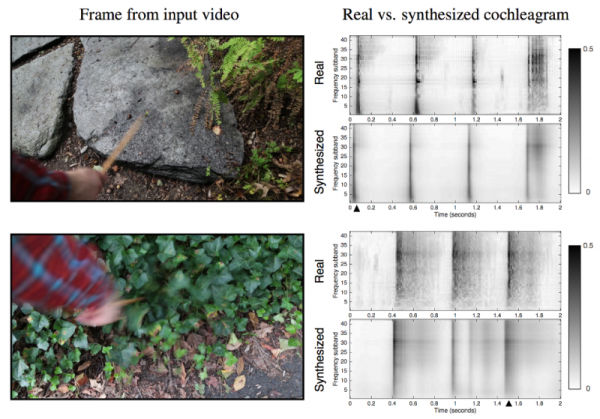

Der neue Algorithmus, entwickelt von Forschern MIT Computer Science and Artificial Intelligence Laboratory, kann Vorhersagen präzise akustischen Qualitäten eines Klanges, und dann äußerst realitätsnah zu simulieren. Bei der Analyse der stillen video-Clips, wie ein Objekt von einem Drumstick getroffen produzieren das System einen Ton für den Hit realistisch genug, um menschliche Zuhörer zu täuschen.

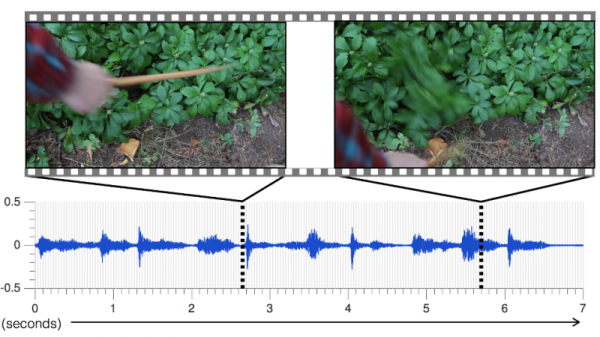

Zu machen, Arbeit, PhD Student Andrew Owens und sein Team Anwendung eine Technik bekannt als "deep Learning", mit dem Computer wichtige Muster völlig autonom in riesige Mengen an Rohdaten begraben herausgreifen kann. Im Laufe von mehreren Monaten erfasst die Forscher etwa 1.000 Videos eine geschätzte 46.000 Klänge, die ein Array von Objekten, die geschlagen, geschabt und anregen durch ein Beinchen dargestellt. (Die Beinchen wurde gewählt wegen seiner Fähigkeit, konsequente Klänge zu erzeugen.) Ein tief-Lernalgorithmus analysiert dann die Videos, die Klänge nach Tonhöhe, Lautstärke und andere akustischen Qualitäten zu dekonstruieren.

"Um dann den Klang eines neuen Videos vorherzusagen, der Algorithmus die Klangeigenschaften jedes Frames des Videos schaut und gleicht sie mit den ähnlichsten Klängen in der Datenbank" bemerkte Owens in MIT News. "Hat das System diese Bits von Audio, es fügt sie zusammen, um eine kohärente Klang zu erzeugen."

Der Algorithmus war unglaublich, simulieren zu können – mit einem überraschenden Maß an Genauigkeit – akustischen Feinheiten der verschiedenen Hits, darunter die Klänge der Trommelstock auf Metall, Holz, Steinen, Schmutz und sogar Blätter. Die synthetische Klänge waren so gut, dass Probanden über die echten doppelt so oft die falschen Töne ausgewählt. Materialien wie Laub und Verschmutzungen waren besonders schwierig zu unterscheiden, die reale Sache, vor allem, weil diese Objekte sind in der Regel weniger "sauber" klingt als andere Objekte haben.

Diese Forschung wird mehr als put Foley Künstler aus der Arbeit zu tun. In Zukunft könnte dieses System verbessern Roboter Fähigkeiten zu bewerten und mit ihrer Umwelt interagieren.

"Ein Roboter könnten betrachten einen Bürgersteig und instinktiv wissen, dass der Zement hart ist und der Rasen weich ist und daher wissen, was passieren würde, wenn sie auf einer von ihnen trat," sagte Owens. "In der Lage, vorherzusagen, Klang ist ein wichtiger erster Schritt auf dem Weg zu in der Lage, vorherzusagen, die Folgen der physikalischen Wechselwirkungen mit der Welt."

[MIT News, ArXiv]