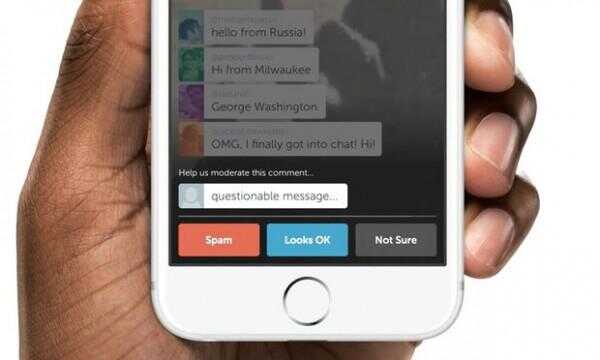

Periskop missbräuchliche live-Kommentare in oder von den Zuschauern gewählt werden

Eine Flash-Jury nach dem Zufallsprinzip ausgewählten Benutzer werden aufgefordert zu entscheiden, ob gekennzeichnete Kommentare beleidigend, Spam oder OK sind

Periskop, Twitter live-Video-Streaming-Dienst, ist das Experimentieren mit einem "Flash-Jury" der Benutzer entscheiden, ob missbräuchliche Kommentatoren verdienen es, von der Website blockiert werden.

Die Funktion ist eines der mehr erfinderisch Mittel gegen beleidigende Kommentare, ein Problem, das ist besonders schwer zu verwalten auf einer Plattform, wo alle Kommentare auf einer Live-Sendung und manchmal sogar über das Gesicht des Senders überlagert werden.

Die Funktion können Zuschauer Bericht Kommentare als Missbrauch oder Spam, während die live-Übertragung im Gange ist. Eine zufällig ausgewählte kleine Jury der Zuschauer wird dann aufgefordert, ob Stimmen: sie kommen überein, der Kommentar war Missbrauch oder Spam; Es sieht OK; oder sie sind nicht sicher.

Wenn die Mehrheit den Kommentar ablehnen, kann nicht der Täter eine Minute lang ein weiteres Kommentar posten. Wenn der Täter eine zweite beleidigende Bemerkung Beiträge, sind sie aus der Sendung blockiert. Kommentare können auch unter der Flagge absichtlich vage "anderen Gründen" gemeldet werden, die auf Bericht Kommentare in anderen Sprachen verwendet werden soll; Sender finden diese oft irritierend, doch sie sind nicht missbräuchlich oder Spam.

Das Feature wurde für sechs Monate mit einer kleinen Test-Gruppe entwickelt. Aaron Wasserman, Periskop Oberingenieur, sagte zielte darauf ab, beleidigende Kommentare auf der Website beschäftigen, aber ohne die Last des Senders hinzuzufügen, indem man kennzeichnen sie herauf beleidigende Kommentare. Wassermann, sagte, dass es bezeichnend, dass die zufällige Jury Menschen zusammengesetzt wird, die die volle Sendung gesehen haben, so können sie den Kommentar gegen den Gesamtkontext und Ton des Stückes beurteilen.

"Die Sache, die macht, die Macht [Periskop] so schön ist, es ist ein intimes Erlebnis, aber wir haben festgestellt, die mit dieser Intimität das Potenzial für kam Missbrauch in eine ziemlich bedeutende Weise... Kommentare sind vergänglich...", sagte er." Diese Kommentare sind fast verschwunden, so schnell wie sie angezeigt werden und der Schaden, so schnell angerichtet ist." Wasserman fügte hinzu, dass das Unternehmen im vergangenen Jahr, darunter Rundfunkanstalten Block Menschen verschiedene Moderationsmethoden versucht oder hatte um Publikum auf ihre eigenen Anhänger nur – zu beschränken die Verantwortung auf den Sender.

Sarah Haider, Leiter der Client engineering bei Periskop, sagte, dass einige gemeinsame Moderationstechniken beteiligt blacklisting bestimmte Wörter, aber, dass diese Methode zu grob war und konnte nicht den Kontext des Gesprächs zu berücksichtigen. "Eine Bemerkung in einer Sendung könnte sein" OK "in einem anderen Kontext – es ist wirklich schwierig für eine Maschine zu verstehen," sagte sie. "Niemand hier ist bequem machen Periskop des Richters."

Wasserman hinzugefügt, dass das Team sammeln und die Ergebnisse in ihrer Gesamtheit analysieren zu verstehen, die Verhaltensweisen und Auslöser von Missbrauch Kommentare und Berichterstattung verbessern würde.

"Wir gehen nicht auf Internet-Missbrauch zu lösen – gibt es keinen Königsweg – aber meine Hoffnung ist, dass dies helfen wird," sagte er. Twitter würde die neue Funktion genau beobachten, fügte er hinzu, aber die Methode war wahrscheinlich nicht direkt nützlich für Twitter, dessen archivierte, veröffentlichten Tweets derzeit eine sehr andere Herausforderung, Periskop in Echtzeit arbeiten ist, ephemere Kommentare.

Periskop entbindet nicht Nutzerzahlen aber sagte 200m-live-Übertragungen im ersten Jahr bis März 2016 erstellt wurden.