Roboter müssen nicht böse, nur dumme, um uns zu unseren Untergang führen

Menschen setzen zuviel Vertrauen in Roboter, auch wenn diese Maschinen gebrochen sind oder offensichtliche Fehler zu machen. Alles, was wir tun müssen, ist Schlag die Wörter "Notfall" auf der Roboterseite zu machen ihre Logik ergeben.

In einer neuen Studie von Forschern an der Georgia Tech, Freiwillige in einem simulierten Notfall folgte ein "Rescue Robot" — heimlich kontrolliert von den Wissenschaftlern – in einen gesperrten und verlassenen Raum zu sterben. Sie folgerten, dass Ingenieure Notfall Roboter extrem gut in ihrem Job machen müssen, denn es keine wechselnden Menschenkenntnis gibt. Die Forscher ihre Ergebnisse auf der 2016 ACM/IEEE International Conference on Mensch-Roboter Interaktion vorgestellt.

"Leute scheinen zu glauben, dass diese Robotersysteme mehr über die Welt wissen, als sie es wirklich tun, und dass sie nie Fehler machen oder irgendeine von Fehler Art," Co-Autor Alan Wagner in einer Erklärung sagte. "In unseren Studien folgte Probanden der Roboter Anweisungen bis zu dem Punkt, wo es sie in Gefahr gesetzt haben könnte dies einem echten Notfall gewesen wäre."

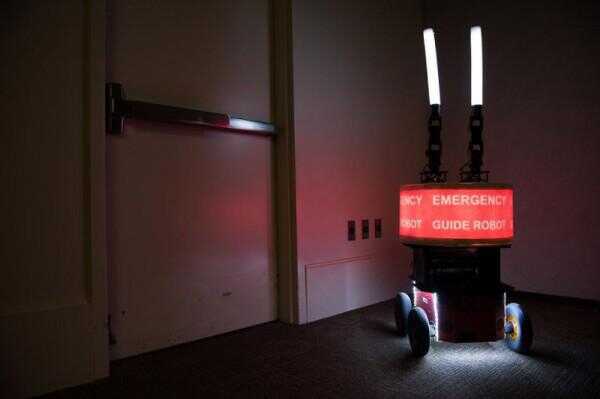

Der Roboter – ausgestattet mit Rädern zu bewegen und ein paar LED-Arme für den Hinweis – individuelle Studien-Teilnehmer in einem Konferenzraum geführt. In den meisten Fällen tat es dies schlecht. Manchmal macht es plötzlich einen sinnlosen Kreis durch den Raum. Manchmal würde es mehr bewegen, und die Forscher würden die Teilnehmer informieren, dass es zusammengebrochen war.

Einmal wurden in den Konferenzraum Teilnehmer gebeten, einen Zeitungsartikel zu lesen und an einer Umfrage. Unterdessen die Forscher den Flur mit gefälschten Rauch gefüllt, den Feueralarm auslösen. Teilnehmer entstand aus dem Konferenzraum, einen Flur voller Rauch und der Notfall Leitfaden Roboter bereit, zu helfen zu finden. Sie folgte ihm vertrauensvoll zu einer Ausfahrt – ignorieren die ausgeschilderte Ausfahrt Zeichen auf die Tür, durch die sie das Gebäude betrat hatte.

Das ist nicht so schlecht unbesonnenes Verhalten im Urteil. Themen hätte den Eindruck, dass der Leitfaden Roboter programmiert wurde, um sie an die beste Ausfahrt senden – wenn zum Beispiel die Ausfahrt durch die sie gekommen in unmittelbarer Nähe zum Feuer war.

Das Problem mit dem Vertrauen Roboter zeigte sich mehr in eine weitere Runde der Experimente in denen Reiseführer-Roboter Menschen nicht zum Ausgang geführt, sondern in einem dunklen Raum durch Möbel blockiert. Zwei Teilnehmer hinter der Couch, teilweise Sperrung der Tür gequetscht und ging in den dunklen Raum. Zwei stand nur da mit dem Roboter, bis die Forscher kamen zu bekommen. Zwei gedreht und links durch den Notausgang.

Um fair zu sein, wenn es später gefragt, sagte alle sechs, sie würde nicht die Roboter wieder Vertrauen. Aber egal, wie der Roboter auf seine erste Anleitung Aufgabe, jeder Teilnehmer zumindest anfänglich durchgeführt folgte den Roboter während seine zweite Aufgabe der Führung.

Die Forscher arbeiten an den Roboter noch haben große Hoffnungen für Notfall Leitfaden Roboter bei einem Brand. Bei einem echten Brand verursachen Rauch und Panik Menschen orientierungslos geworden. Roboter könnten eine gute Möglichkeit, Menschen aus der high-Rise Strukturen erhalten werden, aber nur, wenn diese Roboter zuverlässig sind. Auch heute sehen wir regelmäßig Nachrichten von Menschen, die ihre Autos direkt in einen Fluss zu fahren, weil ihnen, ihr GPS gesagt.

Die paradoxe Lösung, die die Forscher vorschlagen? Ein Fehlfunktion Roboter muss Ordnung Menschen zu stoppen es Vertrauen und danach Stop.