Unser Gehirn speichert 10 Mal mehr Informationen als wir dachten

Neue Forschung zeigt, dass das Gehirn die Speicherkapazität ist zehnmal höher als in früheren Schätzungen. Das heißt, es liegt im Petabyte-Bereich– was bringt es in der Nähe von World Wide Web Gebiet.

Das menschliche Gehirn ist oft mit einem Computer verglichen. Ein Aspekt vor allem das eignet sich gut für diese Art von Vergleich ist Erinnerung. Wenn Informatiker über Gedächtnis sprechen, beziehen sie sich auf RAM (random-Access Memory) und Festplattenspeicher. Bei Bezugnahme auf das menschliche Gehirn sprechen Neurowissenschaftler von Kurzzeitgedächtnis, die wie RAM und Langzeitgedächtnis, die ähnlich wie eine Festplatte ist. Infolgedessen finden Wissenschaftler ist es hilfreich, unser Gehirn ausreichend Speicherkapazität für einen Computer analogize, was erklärt, warum sie es in Bits und Bytes zu messen.

Leider gibt es ein Mangel an Konsens über wieviel Informationen unsere Gehirne speichern kann sind. Schätzungen schwanken zwischen einem Terabyte und 100 Terabyte auf 2.500 Terabyte (ein Terabyte werden 1.000 Gigabyte). Aber wie eine neue Studie aus der Salk Institute zeigt, scheinen diese Schätzungen eine Größenordnung zu niedrig zu sein. Sie erstellen eine computergestützte Rekonstruktion eines Segments einem Rattengehirn, hat ein Team unter der Leitung von Salk Institute Terry Sejnowski gezeigt, dass das menschliche Gehirn Speicherkapazität tatsächlich im Petabyte-Bereich. Die Details ihrer Arbeit finden Sie jetzt die Wissenschaft Zeitschrift eLife.

"Dies ist eine Bombe auf dem Gebiet der Neurowissenschaften," sagte Sejnowski in einer Pressemitteilung. "Wir entdeckten den Schlüssel zum Entriegeln des Konstruktionsprinzip wie hippocampal Neuronen-Funktion mit niedriger Energie aber hoher Rechenleistung. "Unsere neuen Messungen der Speicherkapazität des Gehirns erhöhen vorsichtigen Schätzungen um einen Faktor von 10 bis mindestens ein Petabyte, in derselben Liga wie das World Wide Web."

Um fair zu sein, ist es im gleichen allgemeinen Bereich wie das Web, aber es ist nicht ganz in derselben Liga wie das Web. Die Salk Forscher scheint es ein bisschen übertrieben sein. Betrachtet man die großen vier – Facebook, Google, Amazon und Microsoft – allein ihren Servern speichern mindestens 1.200 Petabyte dazwischen. Das schließt den Rest des Webs, einschließlich Speicheranbieter wie Dropbox, Barracuda und SugarSync.

Aber ein Petabyte ist immer noch eine enorme Menge an Daten. Numerisch ausgedrückt, ist es 250 Bytes. Eine gute Analogie ist die Gesamtmenge der Daten sammelte bei der US Library of Congress, die beträgt ca. 235 Terabyte. Ein Petabyte ist etwa viermal so groß. Noch anders ausgedrückt: ein Petabyte ist genug, um die DNA der gesamten Bevölkerung der Vereinigten Staaten zweimal zu speichern. Also unser Gehirn nicht über die entsprechende Speicherkapazität des gesamten Web verfügen, aber es immer noch ein großer Datenmengen-Reservoir ist.

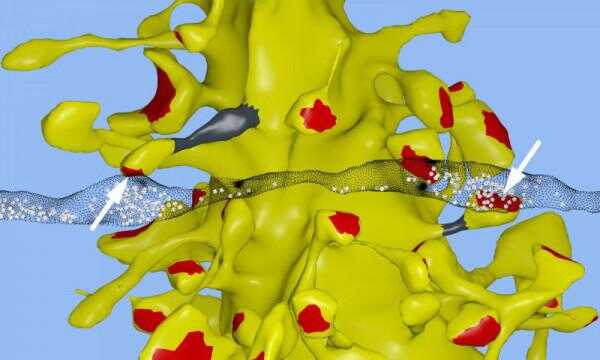

Das Team erstellt eine computergestützte 3D-Rekonstruktion der Ratte hippocampal Gewebe (der Speicher-Zentrum des Gehirns), die etwas ganz Unerwartetes offenbart. Bestimmte Neuronen erschien es zu doppelte Nachrichten senden, empfangen von Neuronen. Neugierig geworden, beschlossen die Forscher messen und vergleichen die Größe der zwei ähnliche Synapsen, die sie hofften, ihr Verständnis von synaptischen Größe verfeinern würde. Im Gegensatz dazu wie Neurowissenschaftler in der Regel auf die Größe der Neuronen in Bezug auf kleine, mittlere und große verweisen. Das ist problematisch, da die Speicherkapazität von Neuronen hängt von der Größe der Synapsen.

Die Forscher entdeckten, dass Synapsen aller Größen in acht-Prozent-Schritten variieren. So gäbe es weniger als 26 Kategorien der Größen der Synapsen. Diese "synaptische Plastizität" bedeutet, dass es 10 Mal mehr diskreten Größen von Synapsen als bisher angenommen. Rechnerische ausgedrückt entspricht das etwa 4,7 Bits von Informationen. Vor dieser Studie Neurowissenschaftler gedacht, dass das Gehirn in der Lage, nur ein bis zwei Bits für kurz- und Speicher im Hippocampus war.

"Das ist etwa eine Größenordnung von Präzision mehr als jemand jemals gedacht hat," sagte Sejnowski.

Diese Entdeckung hilft auch um zu erklären, das Gehirn ist überraschend Effizienz, die schließlich, zu Ausrichthülsen, super-effizienten führen könnte, Computer, einschließlich derer, die tief Lern- und künstliche Netze nutzen. Also auf die gleiche Weise, die Computer uns helfen, das menschliche Gehirn zu verstehen, helfen diese Art von neuronalen Erkenntnisse uns dabei effiziente und leistungsstarke Computer zu bauen.

[eLife]

Bild oben: Salk Institute