Die 5 schrecklichsten Roboter-Fortschritte in der jüngeren Geschichte

Roboter sind erschreckend. Wer anderes sagt ist ein Roboter-Wissenschaftler oder jemand, der furchterregende Roboter durch eine schreckliche ersetzt wurde. Denke, dass wir übertrieben sind? Denke, wir sind hyperbolische, reflexartige Neo-Luddismus aus Gründen der Komödie befürworten? Wahrscheinlich! Aber dann, wenn Roboter so harmlos sind, erklären, warum Wissenschaft...

#5. Geben Computer Schizophrenie

Forscher an der University of Texas-Austin haben es geschafft! Sie haben es endlich geschafft, psychische Erkrankungen in den Bereich der Computer zu übertragen: sie gaben eine Supercomputer Schizophrenie. G -... gute Arbeit, Jungs?

War dies eine tatsächliche Kontrollkästchen auf der großen Liste der wissenschaftlichen Leistung--machen verrückt künstliche Intelligenzen? Wir sind sicher, dass bestimmte Zeile nach der Tat von einem verärgerten Praktikanten oder etwas in Bleistift war nicht?

Darüber hinaus ist es zu spät jetzt, weil DISCERN eine sehr reale Sache ist. DISCERN ist ein neuronales Netz: einen künstlichen Geist durch die Simulation menschlichen Gehirn Verbindungen erstellt. Um den Mechanismus hinter Schizophrenie zu beschreiben, postuliert Wissenschaftler die Hyperlearning Theorie, die besagt, dass schizophrene zuviel Informationen behalten. Sie lernen Dinge, die Sie nicht und können nicht die Informationen gerade halten.

Wissenschaftler dann emuliert Schizophrenie in eine künstliche Intelligenz (wir sind ziemlich sicher, dass nur die Eingabe dieser Satzes ist technisch ein Kriegsverbrechen) erzählt des Computers eine Reihe von Geschichten, Beziehungen zwischen Wörtern und Ereignisse einrichten lassen, und ermöglicht es, sie als Erinnerungen mit nur die relevanten Details zu speichern. Es hat ziemlich gut funktioniert. Dann sie Amping die Speicher-Encoder, wodurch es zu behalten alle Details, relevant oder nicht, und boom: Roboschizo. Der Computer verloren Überblick, was sie gelehrt wurde, und konnte kohärenteren Erzählungen nicht weiterleiten.

Wie verrückt habe es bekommen?

An einer Stelle übernahm es die Verantwortung für einen terroristischen Anschlag. Es erzählt buchstäblich die Forscher, dass es eine Bombe platziert hatte. Die AI tat dies, weil es einen Drittperson-Bericht verwechselt über einen terroristischen Bombenanschlag mit einem First-Person "Gedächtnis", die es beibehalten. Durch eine einfache EDV Fehlzündung setzen sich versehentlich ein Supercomputer in die Rolle eines Terroristen. Wir sind ziemlich sicher, dass das Grundstück für WarGameswar.

In einem anderen Beispiel gruselig fing an, der Computer vollständig in der dritten Person, wie eine kybernetische Version des Felsens (Dibs auf Filmrechte). Sie wusste einfach nicht welche Stelle es mehr sein soll. DISCERN hatte einen fehlerhaften Sinn des selbst entwickelt. Hoffentlich haben sie bereits eine Art Roboter Antipsychotika entwickelt, sonst die University of Texas-Austin-Wissenschaftler sind sicheres gehen, haben Ei auf ihren Gesichtern, wenn die Roboter starten aus Essen.

#4. Lehre-Roboter liegen

Wissenschaftler haben einer Gruppe von Robotern lehrten einige Strategien für Täuschung und Betrug, das ist nicht annähernd so überzeugend wie schreien "Roboter liegen gelernt haben." Wir werden also mit der letzteren.

ROBOTER HABEN LÜGE, EUCH GELERNT.

Diese Strategien wurden Vögel und Eichhörnchen Verhalten nachempfunden, (weil Eichhörnchen offenbar die tricksiest motherfucker in der Tierwelt sind), und wurden demonstriert hatte Professor Ronald Arkin aus Georgia Tech School des interaktiven Computing einen Roboter navigieren, einen Kurs, um ein Versteck zu finden. Dann schickte er eine zweite Roboter versuchen, das erste man zu finden, an welcher Stelle die Wissenschaftler der preisgekrönten Bot für eine gute Arbeit (vermutlich mit Cyber-Schlag und Kleine Robo-Hookers) belohnen würde.

Es funktioniert wie folgt: die Bots waren soll um einen Pfad mit voreingestellten Hindernisse zu folgen, die unten geklopft habe, sie mit fortschreitender. Eines davon lief des Kurs und die andere versuchte dann, die umgestürzten Markierungen finden die ersten folgen. Die Versteck-Roboter erfuhr das System, und würde absichtlich klopfen über andere Hindernisse nur um eine falsche Spur zu erstellen. Es würde dann irgendwo weit weg aus dem Schlamassel verstecken, die er geschaffen hatte. Es ist eine einfache Taktik, aber mit ihm, das Versteck Droid war in der Lage, den Suchenden zu 75 Prozent der Zeit betrügen.

Wieder war diese Strategie nicht in den Roboter von Anfang programmiert. Es ist etwas, das es abgeholt und ganz auf seine eigenen durch Versuch und Irrtum entwickelt. Gute Sache das ist nur ein sanftmütiger Universität Experiment, richtig? Stellen Sie sich das Militär nutzte diese wörtliche Decepticons...

Ach, du hast uns: Natürlich sind sie! Dieser harmlose akademischen Lerche passiert einfach durch das Office of Naval Research finanziert werden. Sie planen, mit Hilfe von Robotern wie diese "Munition und anderen lebensnotwendigen Gütern zu schützen." So sind sie bewaffnet! Und sie verstecken sich wirklich gut! Klingt wie ein Plan, Verräter an der Menschheit.

Oh, aber wir sich keine über diese List und trügerische Militärroboter sorgen sollten vielleicht: die Entwickler haben dargelegt, eine Asimovian Serie von Protokollen für die Roboter erfüllen, bevor sie liegen können. Hier sind sie: die Situation hat, einen Konflikt zu beteiligen, an denen der Roboter beteiligt ist, und der liegende Roboter hat, von der Täuschung zu profitieren.

Das ist es!

Vertrauen Sie nicht den Roomba.

#3. Lehre Roboter Rücksichtslosigkeit

Wissenschaftler am Labor von Intelligent Systems nahm eine Gruppe von Robotern, "Nahrungsquelle" und "vergiften" Quelle und setzen Sie sie alle zusammen in einem Raum. Gute Arbeit, Jungs. Es ist vielleicht ein wenig verwirrt, zu versuchen, einen Roboter zu vergiften, aber wir loben die Mühe; Ihr seid wirklich ein Segen für den Fortbestand der Menschheit. Leider ist der Roboter nicht gestorben. Sie lernten einfach die Torheit der Barmherzigkeit.

Sehen Sie, die Roboter kommen würde "Punkte" für den Aufenthalt neben einer Nahrungsquelle fanden sie und verlieren sie Nähe zu vergiften. Die Bots hatte wenig Blaulicht mit ihnen verbunden, die Leuchten würde, nach dem Zufallsprinzip (obwohl sie auch das Licht kontrollieren könnten, wenn sie wollte, das Sie sich erinnern sollten, denn es wird später in erschreckend kommen) und eine Kamera wahrzunehmen sagte Licht. Als die Studien begann, dauerte es nicht die Roboter um lange zu erfahren, dass die größere Dichte von blauem Licht wo die anderen Roboter sammeln waren--d.h., wo das Essen war. Durch ihre blaue Lichter nach dem Zufallsprinzip aussenden, wurden die Roboter im Wesentlichen selbst Schrauben; Sie waren den anderen zeigen, wo war das Essen und geben ihnen Punkte.

Deshalb, nach ein paar versuchen, die meisten Roboter nicht mehr blinken ihre Lichter. Fast vollständig. Setzen wir die Roboter zu einer Aufgabe, und das erste, was, das Sie tat, war weigern, einander zu helfen. Es ist wahrscheinlich gut für die Menschheit insgesamt. Etwas beunruhigend, aber es noch nicht zu Ende: einige Roboter unter der Leitung von Nahrungsquellen, mehr, ihr Licht zu blinken, um andere in die Irre führen. Gingen sie volle Rattenfänger.

#2. Supercomputer zu geben, die Macht der Phantasie

Zu den vielen Google-Projekte, die sicherlich eines Tages zum Untergang der Zivilisation führt, zählt ein neuronales Netz lernen. Sie wissen, wie der schizophrene von früher? Dieses ist nicht schizophren, aber es gewinnt unheimlichen Aspekte des Empfindungsvermögens. Googles Supercomputer war lose im Internet eingestellt und durfte nach Herzenslust suchen. Es gab keine Grenzen setzen, keine Beschriftungen oder Anweisungen. Gelegenheit, den ganzen Reichtum der menschlichen Geschichte durchsuchen dieses erweiterte Supercomputer wählte..., um Bilder von Katzen sehen.

Ja, es stellt sich heraus, dass wir alle das gleiche das Internet nutzen, werden wir anfällig Fleisch Säcke oder böse digitalisierten Oberherren in der Ausbildung. Lassen Sie uns allein, und wir alle schauen Sie sich die hübschen Kätzchen. In der Tat entdeckte Google bald, dass der Computer tatsächlich, ihre eigene Auffassung entwickelt hatte davon, was eine Katze aussieht, ermöglicht es, stellen Sie sich eine völlig neue Katze basierend auf was es zuvor gesehen hatte. Es hatte etwas wie einen simulierten Sichtrinde entwickelt. Hier ist, was sie sich einfallen lassen:

Hallöchen! Das ist eine ziemlich gerade nach oben Katze. Gute Arbeit, Computer.

Weshalb es so beunruhigend ist, dass dies ist, was es denkt, dass menschliche Wesen sind:

Jesus Christus! Wir sind alle Slenderman?! Würden wir, dass AI, würden wir herausfinden, ein Weg, um uns die schreckliche Leere-eyed Monster so schnell wie möglich zu töten. Einige Kätzchen Kuscheln Zeit freisetzen.

#1. Roboter zu machen, die die Zukunft sehen

Die Nautilus ist noch ein weiteres Lernen Supercomputer. Diese Millionen von Nachrichten, gehen wir zurück zu 1945 und bat darum, zwei Dinge suchen gespeist wurde: Stimmung und Lage. Mit diesem riesigen Fundus von Informationen aus Ereignissen der Vergangenheit, konnte zu rückwirkenden Vermutungen auf, was passieren würde, in "the Future." Und seine Vermutungen waren erschreckend genau.

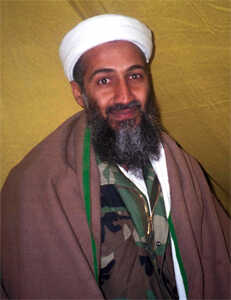

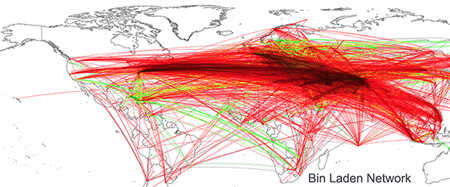

Wie erschreckend genau? Bin Ladens festgestellt.

Nach der Tat, natürlich. Es gab keine spindeldürren, wütend Cyborg treten die Tür, um Osama Verbindung auf dem Raid oder nichts-- aber angesichts genügend Informationen, die Intelligenz seine ungefähre Position herauszufinden.

Es nahm die amerikanische Regierung und ihre Verbündeten, 11 Jahre, zwei Kriege, zwei Präsidenten und Milliarden von Dollar, die Position von Osama bin Laden lokalisieren. Und für den Großteil der Jagd, glaubte er in Afghanistan sein. Es nahm den Nautilus-Computer erheblich weniger Zeit, und durch die Überwachung einfach jede Geschichte, die ihn verwiesen und verknüpfen ihre jeweiligen Positionen, verengt sie sich Nautilus auf einem 200-Kilometer-Bereich im Norden Pakistans. Diesem Bereich enthaltenen Abbottabad, wo seine Verbindung tatsächlich befand.

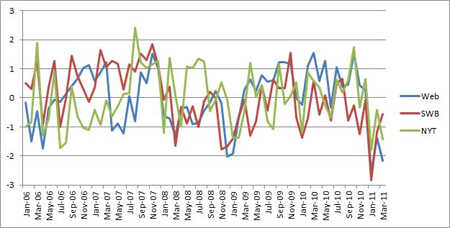

Nein? Tracking ist unten am schwersten Mann der Welt nicht unheimlich genug für Sie? Nautilus kann breitere gehen: es auch geschafft, Vorhersagen, empört sich der Arabische Frühling. Es überwacht relevante Nachrichten Geschichten und sah für ein erfrischendes Bad in Stimmung, sehen wie oft positive und negative Begriffe verwendet wurden. Sie können es passieren in dieser Grafik sehen:

So sind Roboter, die die Zukunft voraussagen können ein wenig Beine verwirrend, vor allem, da sie alle das Aussterben der Menschheit Vorhersagen zu halten, sobald wir sie bauen. Aber bisher ist dies alles rückwirkend: Wir verlosen Nautilus Informationen über vergangene Veranstaltungen und sehen, ob es erraten kann, was wir bereits wissen geschah. Aber Wissenschaftler sind jetzt denken, so dass es zu erraten, auf zukünftige Ereignisse in Echtzeit.

Und wenn das nicht beunruhigend genug, Polizei in Baltimore, Philadelphia und D.C. sind bereits mit Software, die vorgibt, Vorhersagen, Mord, genau wie in Minority Report. Nun, vielleicht ist das eine Übertreibung: die Software stellt einen Algorithmus verschiedener Faktoren, wie Alter der ersten Kriminalität, Verbrechen, und Häufigkeit der Verbrechen, um festzustellen, wie hoch die Wahrscheinlichkeit ein Häftlings auf Bewährung ist Mord begehen oder noch seltsamer, wie wahrscheinlich er ermordet werden. Wir denken, dass die Wahrscheinlichkeit steigt, je mehr hinterfragen sie die Software.

Schauen Sie sich XJs $0,99 Science-Fiction-Novelle auf Amazon hier, mit der Fortsetzung hier. Und natürlich, Sie sollten Blick auf seinem Blog schreiben und stecken ihn auf Twitter.

Weitere Gründe für starten alle Roboter zu zerstören, finden Sie 20 japanische Roboter wahrscheinlich Absicht auf Mord an Sie und die 7 gruseligste realen Roboter.