Dieses Genie Kinect Rig bringt Sie in einem Video-Spiel in zwei Minuten flach

Was wäre, wenn das nächste Mal, Sie ein Videospiel spielten, die Hauptfigur nicht nur sah so aus, Sie hatte aber die gleichen Körper, gleiche Kleidung, gleiche alles? Wie wäre es die Art und Weise ändern, die Sie in auf das Spiel Bezug? Wie wäre es die Art und Weise ändern, die Sie beziehen sich auf die anderen Charaktere drin? Ich habe herausgefunden.

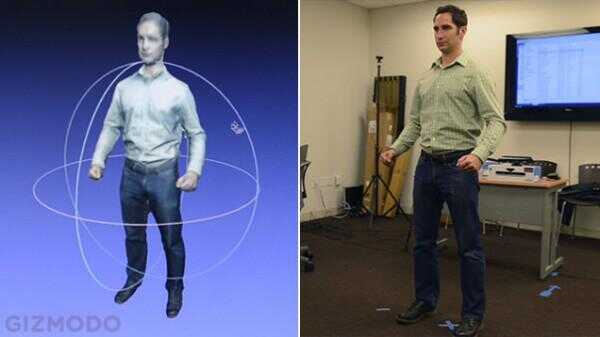

Ein Team gemeinsam unter der Leitung von Ari Shapiro am Institute for Creative Technologies an der USC nur gab uns einen exklusiven ersten Blick auf ein neues System sind sie aufrufenden schnell Avatar erfassen. Es scannt Sie und schafft einen 3D-Avatar können, den Sie in einem Spiel setzen. Und sie tut es in zwei Minuten mit einem einfachen alten Xbox Kinect.

Wenn es vertraut klingt, vielleicht denken Sie an die ähnliche Beweis-von Konzept-Rig, die Nikon auf der CES zeigte. Dort stand Sie in einer riesigen Kugel mit 64 Nikon DLSR Kameras ausgetrickst. Es ein Bild von Ihnen aus jedem Blickwinkel betrachten und dann diese Daten über drei Computer gesendet. Zwei Stunden später verarbeiten mussten Sie einen Video-Spiel-Ready-Avatar. Es sah super aus als es fertig war. Es ist auch völlig unpraktisch für den Heimgebrauch.

Im Gegensatz dazu ist das IKT-Setup nicht nur etwas, was die meisten Menschen leisten können. Es ist eine, die weit über 20 Millionen Menschen bereits besitzen.

So funktioniert es

Ich stand direkt vor einer Kinect und hielt still, während es mir rauf und runter, die tatsächlich fühlte sich ein wenig sah wie zu Arpartments auf. Dann drehte ich mich 90 Grad, so dass es zu meiner Seite, weitere 90, so dass es meinem Rücken Scannen könnte dann eine weitere 90 für meine andere Seite scannen konnte. Dann den Computer (in diesem Fall ein PC tower, aber eines Tages, im Idealfall wird eine Xbox) meine Bilder verarbeitet und ging zur Arbeit, Aufbau eines 3D Modells mit Texturen auf Ober- und Gelenke an den richtigen Stellen. Es verschmolzen dann mein Avatar mit einer Reihe von Verhaltens-Bibliotheken, die die ICT voraus gesetzt hat; laufen, springen und treten zum Beispiel.

In zwei Minuten spuckte es dies:

Nun, zugegeben, das ist nicht überall in der Nähe der Treue, die die Nikon-Rig hatte-es sah aus wie jemand die Seite meines Gesichts mit einer Bowlingkugel zerschlagen – aber das sollte sich bald ändern. Dies ist immerhin der allerersten Generation dieser Software, und mit der original Kinect gedreht wurde. Die Kinect 2 Fotos mit einer viel höheren Auflösung, der dieses Projekt eine große Level-up in der Bildqualität geben wird.

"Gerade jetzt die Zeichen eignen sich für Third-Person-Videospiele und crowd-Simulationen. Sie sind sehr erkennbar aus der Ferne, aber Sie würde nicht unbedingt wollen, dass sie für Face to Face-Interaktionen"Shapiro erzählte uns. "Wie diese Sensoren verbessern, wie unsere Algorithmen verbessern, und wir kommen mit Möglichkeiten, um verschiedene Teile des Körpers bei höheren Auflösungen zu erfassen, werden wir mehr und mehr von Ihrem Verhalten in den Charakter zu integrieren können."

Auf der einfachsten Seite könnte heißt den Ganzkörper-Scan zu tun, und dann setzen Ihr Gesicht rechts oben neben der Kinect zu einen hochauflösenden Scan deines Gesichtes aufgenommen werden. Seitlich komplexer es könnte weiterentwickelt werden, um Sie zu Fuß durch den Raum und gehen durch einige gewohnheitsmäßigen Bewegungen mit den Händen, also nicht nur würde es aussehen wie Sie, aber es könnte erfahren Sie, wie Sie gehen, wie Sie stehen und Geste, wie Sie auch. Plötzlich, steuerst du nicht nur Solid Snake. Sie sind Solid Snake.

Klingt weit hergeholt, aber es kann nicht weit weg sein. Shapiro, sagte, dass er besser zu meistern und Treue Hand und viele weitere Verhaltensweisen innerhalb des Jahres hinzugefügt werden erwartet.

Im Spiel erhalten

Wir haben alle verbrachte Stunden versucht, Madden Football-Spieler zu machen, die aussehen wie uns, WWE Wrestler oder sogar Bommel-headed Miis, die eine flüchtige Ähnlichkeit zu tragen. Jetzt, anstatt eine mühsame Annäherung haben wir die reale Sache.

"Für mich, es ändert sich was ein Avatar ist," sagt Shapiro. "Du musst nicht konstruieren einen Avatar mehr Zeit verbringen. Wenn Sie darüber nachdenken, wie Menschen im Laufe der Zeit ändern, können Sie jeden Tag einen Avatar erfassen. Sie könnte sehen, wie Menschen im Laufe der Zeit entwickeln."

Betrachten Sie auch, die Möglichkeiten eines mixed-Reality-Avatars, wo Sie selbst scannen und bearbeiten Ihre eigenen Features. Sie könnten gönnen Sie sich einen riesigen Kopf und winzigen Beinen oder fügen ein Mohawk oder eine Disco Einteiler. Wie viel Freiheit Sie hätte wäre bis zu den Spiele-Entwicklern, aber was die Technik angeht, es ist gut erreichbar.

Wenn es um Spiele geht, sieht Shapiro erhöhten menschlichen Interaktion innerhalb der Welt des Spiels als ein wesentliches Argument:

"Ich denke, Spiele, die einen sozialen Aspekt, wo Sie wirklich mit anderen Menschen interagieren werden die interessantesten und am häufigsten verwendet. Es ist etwas, wenn Sie einen Avatar mit einer anderen Person sehen Sie erkennen nicht, man könnte denken, es ist eine interessante Technologie. Es ist etwas anderes, wenn Sie jemanden sehen, die Sie kennen – Ihre Familie, Ihre Freunde, Ihre Kinder. Dann hat es Bedeutung für euch."

Das ist wahrscheinlich der beste Anwendungsfall, sicher, aber ich kann nicht umhin, sich Fragen: wie wäre es, ein Mortal Kombatspielen-Stil Spiel als euch selbst, dann Sie, Wirbelsäule Ihres Freundes Rippen und zeigen Sie es ihm, bevor er es tut? Oder du bist in einer Schlacht Royale in einem Halo-Art das Spiel, Sie haben Ihre Scharfschützen Umfang auf der Rückseite des jemandes Kopf ausgebildet, sie dreht sich um, und es ist deine Freundin. Es wäre furchtbar störend, oder einfach ein Witz? Wir werden früh genug erfahren.

Non-Gaming-Anwendungen

Die Auswirkungen gehen weit über Ihre Xbox. Das US-Militär (die ein Teil der Finanzierung für dieses Projekt bietet) ist bereits Anfang, virtual Reality und andere Computer-Simulationen in Ausbildung zu integrieren, und sie haben ein großes Interesse bei der Personalisierung der Zeichen in den Simulationen zum Ausdruck gebracht werden sie ausgeführt.

"sie haben Simulationen für Soldaten, die verschiedenen Szenarien, Kader Formationen und whatnot Kriegsspiel-" Shapiro hat uns gesagt. "Sind sie interessiert, kommen mit einer individualisierten Darstellung jeder Soldat, und diese Technologie könnte für diesen Zweck verwendet werden. Also selbst wenn Sie die gleiche uniform wie alle anderen tragen, Ihre Größe anders ist, unterscheiden sich die Gesichter. Es ist tatsächlich sehr verschieden, wenn du von Mensch zu Mensch gehst."

In einer Kampfsituation, es ist wichtig zu wissen, dass Sie mitlesen (Schutz oder schießen) die richtige Person. Das ist, warum es entscheidend ist, dass diese Simulationen sind so realistisch wie möglich, so dass wenn Sie mit der tatsächlichen Situation konfrontiert sind, die Sie automatisch reagieren. Dies wäre einen dramatischen Schritt näher auf das wirkliche Leben von generischen Avatare mit Nummern drauf.

Und dann gibt es Sex, der eine für alles, was Zwangsläufigkeit Internet. Wie viele virtuelle Positionen könnte diese Entwickler einfallen lassen? Werden VR Mädchen die neue Camgirls? Wie wäre es, eine Nachbildung des selbst Eingriff in eine sexuelle Handlung, die wäre auch nur im entferntesten möglich, dass Sie im wirklichen Leben (da Sie nicht dreifach verbunden sind) zu sehen? Es wäre ein Turn-on, oder wäre es darin störend? Wir sind wahrscheinlich schon bald herausfinden.

Etwas anderes, das sagte Shapiro blieb bei mir: "Können Sie erstellen eine Crowd-Simulation sehr schnell mit einer Vielzahl von verschiedenen Menschen." Das ist, zwar nicht so schlimm, wenn das Publikum mit Freunden gefüllt ist was passiert, wenn Sie laufen von persönlichen Freunden? Können Sie eine Menge mit den Gesichtern der anderen Benutzer füllen? Was passiert, wenn jemand deinen Avatar in komplizierter Weise verwenden wollte? Wem gehört dein Avatar, nachdem Sie es hochladen?

Natürlich hängt das Spiel und/oder Gaming-System, aber vielleicht möchten einen sorgfältigen Blick auf die Nutzungsbedingungen zu nehmen, wenn Sie ein Spiel zu installieren. Oder wer weiß? Sie könnten am Ende konnte immer von einer Prostituierten in ein fremdes Kopie von Grand Theft Auto erstochen.

So... Wann?

Es ist ziemlich bemerkenswert bereits, was die IKT-System gegeben, es ist wie neu. Wir fragten Shapiro, ob sie bereits alle Videospiel-Unternehmen schnell erfassen Avatar gesprochen hatte. Er sagte, sie hatte noch nicht, aber sie hofften natürlich, dass es Interesse geben würde. Die Animation der Software, genannt SmartBody, die Hälfte ist bereits Open-Source und verfügbar online. Der neuere Teil der Erfassung der Technologie kam von anderen Forschungsgruppen innerhalb USC, unter der Leitung von Evan Suma, Gérard Medioni und andere (vollständige Credits hier).

Gefragt, ob die Capture-Software frei gehen könnte und Open-Source sowie Shapiro ein wenig schüchtern bekam, sagen, sie hätten zu sehen. Wir glauben, dass eine große Spielefirma (möglicherweise Microsoft?) zupfen wird nach unten einen großen Teil des Wandels Dibs aufrufen, bevor dies geschehen kann. Dann wird die Frage, wann wir in der Lage, es in unseren Häusern sind wirklich über das abhängen, wer die Lizenzen besitzt.

Spannend ist, dass wir hier bereits ein funktionierendes System haben. Alles was übrig bleibt ist verfeinert und erweitert. Erhöhung der Auflösung ist offensichtlich eine große Kiste zu überprüfen, aber es klingt wie eine der einfacheren Aufgaben, die sie zu bewältigen. Als nächstes müssen sie die Charakter-Bewegung natürlicher machen (ich schwöre, dass ich nicht wie das laufen) und erweitern das Repertoire der Verhaltensweisen. Von dort könnte es ab zu den Rennen sein.

Der Punkt des Systems, ist wie Shapiro, sagt ", um Sie besser mit Ihrem virtuellen selbst zu verbinden." In einer Zeit, wenn so viele von uns zwischen und ausstecken ganz gerissen sind, ist es interessant zu betrachten, wie die Landschaft der menschlichen Erfahrung in der virtuellen Welt ändern könnte mehr vollständig einstecken. [Schnelle Avatar Capture]

Vielen Dank an alle im USC-Institut für kreative Technologien für ihre Zeit.

Kamera: Judd Frazier

Edit: Michael Hession