Eine kurze Geschichte des Stephen Hawking wird ein Bummer

Stephen Hawking ist es auch hier sagen es ist eine "in der Nähe von Gewissheit", dass eine selbstverschuldete Katastrophe Menschheit innerhalb der nächsten tausend Jahre oder so widerfahren wird. Es ist nicht das erste Mal der weltweit berühmtesten Physiker auf die Apokalypse alarmiert hat, und er beginnt, ein echter Wermutstropfen zu werden. Hier sind einige der anderen Zeiten Hawking gesagt hat, das Ende ist nahe – und warum er braucht, um seine Botschaft zu verändern beginnen.

Im Gespräch mit der Radio Times kürzlich vor seinem BBC Reith Vortrag sagte Hawking, dass laufende Entwicklungen in Wissenschaft und Technik bereit sind, um zu erstellen, "neue Wege kann schief gehen." Der Wissenschaftler verwies auf Atomkrieg, globale Erwärmung und genetisch-Engineering Viren als einige der schlimmsten Übeltäter.

"Obwohl die Chance auf eine Katastrophe auf dem Planeten Erde in einem bestimmten Jahr ziemlich niedrig sein kann, im Laufe der Zeit summiert sich zu einem in der Nähe von Sicherheit in den nächsten tausend oder zehn tausend Jahren," wurde er zitiert. "Bis dahin, die wir in den Weltraum und zu anderen Sternen ausgebreitet haben sollte, würde also es nicht das Ende der Menschheit bedeuten. Jedoch etablieren nicht selbsttragende Kolonien im Raum für mindestens die nächsten hundert Jahre wir haben wir in dieser Zeit sehr vorsichtig sein."

Hawking beginnt zu klingen wie eine kaputte Schallplatte. Natürlich behauptet er, ein Optimist über der Menschheit Einfallsreichtum beim Aufkommen mit Möglichkeiten, die Gefahren zu steuern sein. Aber er hat kein Problem mit diese bedrohlich spezifische, schreckliche Dinge, die uns in der Zukunft passieren könnte. Er ist nicht falsch, diese Gefahren bestehen – aber in Bezug auf was wir eigentlich über tun sollen, seine Antworten sind frustrierend vereinfachend und undurchsichtig, in scharfem Kontrast zu seinen Prognosen des Untergangs.

Hawkings Warnungen gehen zurück mindestens ein Jahrzehnt. Im Jahr 2006 veröffentlicht er eine Online-Frage,

In einer Welt, die im Chaos ist politisch, verträgt sozial und ökologisch, wie die menschliche Rasse einen anderen 100 Jahre?

Der Kommentar berührt einen Nerv, woraufhin mehr als 25.000 Menschen, Glockenspiel mit ihrer persönlichen Meinungen. Eine Reihe von Menschen zeigten sich enttäuscht mit Hawking wegen Nichtumsetzung der seine eigene Frage zu beantworten. Wie ein Befragter schrieb, ist"es zu wissen, dass diese Frage von einer der intelligentesten Menschen auf dem Planeten gestellt wurde bereits ohne eine klare Antwort... ernüchternd." Um zu klären, schrieb Hawking später, "Ich weiß die Antwort nicht. "Das ist, warum ich die Frage gestellt."

Im folgenden Jahr warnte Hawking das Publikum auf einer Pressekonferenz in Hong Kong, das "Leben auf der Erde ist auf die immer größer werdende Gefahr, ausgelöscht durch eine Katastrophe, wie plötzliche globale Atomkrieg, gentechnisch veränderte Viren oder anderen Gefahren, die, denen wir noch nicht gedacht haben."

Einige Hawking es größte Bedenken haben mit AI, zu tun was er sagt, könnte sein "unsere schlimmsten Fehler in der Geschichte." Im Jahr 2014 Hawking zusammen mit Physikern Max Tegmark und Frank Wilczek, beschrieb die potenziellen Vorteile von AI als riesig, aber gesagt, wir können nicht vorhersagen, was passieren wird, wenn diese Kraft vergrößert wird. Wie die Wissenschaftler schrieb:

Man kann sich vorstellen, dass solche Technologie austricksen Finanzmärkte, out-menschlichen Forscher erfinden, out-Manipulation menschlichen Führer und Entwicklung von Waffen, die wir nicht einmal verstehen können. Die langfristige Auswirkungen hängt von während die kurzfristige Auswirkungen der AI, hängt davon ab, wer es kontrolliert, ob sie überhaupt gesteuert werden kann.

Im vergangenen Jahr Hawking geschoben verantwortlich AI Aufsicht und unterschrieb er einen offenen Brief fordern ein Verbot von "autonomen Angriffswaffen über sinnvolle menschliche Kontrolle."

Aber nicht alle über die Gefahren von Hawking zitiert sind hausgemacht. Neben riesigen Kometen und Asteroiden hat Hawking sagte, dass wir auch eine alien-Invasion kümmern müssen. Da er des Londons erzählte zurück Sunday Times in 2010:

Wir müssen nur schauen uns zu sehen, wie intelligentes Leben könnte in etwas wir würde nicht wollen, zu entwickeln. Ich mir vorstellen, dass sie in massiven Schiffe existieren könnte alle Ressourcen von ihrem Heimatplaneten genutzt haben. Solche fortgeschrittenen außerirdischen würde vielleicht werden Nomaden, die schauen, um zu erobern und kolonisieren welchem Planeten sie erreichen... Wenn Außerirdische jemals uns besuchen, denke ich, das Ergebnis wäre viel wie als Christopher Columbus landete zunächst in Amerika, die sehr gut für die Native Americans nicht ausfallen.

Es ist offensichtlich aus diesem und anderen Zitate, dass Hawking ein besonders düsteres Bild des Menschen hat. In dem Buch Stephen Hawking: Leben und Werk, argumentierte er, dass Computer-Viren eine neue Form des Lebens betrachtet werden sollte: "vielleicht es sagt etwas über die menschliche Natur, dass die einzige Form des Lebens wir bisher haben rein destruktiv ist. Reden Sie über das Leben in unserem eigenen Bilde zu schaffen."

Und wie Hawking betonen gerne, müssen wir das sinkende Schiff zu fliehen. Um unsere langfristige Perspektive zu gewährleisten, hat er immer wieder argumentiert, dass müssen wir diesem Planeten aussteigen und beginnen, andere Welten zu kolonisieren, sagen "Wir haben keine Zukunft, wenn wir nicht in den Raum gehen."

Um fair zu sein, ist Hawking der weltweit berühmtesten Wissenschaftler, so dass alles, was er sagt verpflichtet ist, zusätzliche mediale Aufmerksamkeit und Kontrolle zu bekommen. Und seine Ideen noch nicht wurde aus einem Vakuum (oder ein schwarzes Loch, für diese Angelegenheit). In den letzten 15 Jahren eine wachsende Zahl von europäischen Wissenschaftlern – viele davon mit Sitz in Großbritannien – geworden besorgt über so genannte "existenzielle Risiken." Während einmal das Wiederkäuen der Panikmache Huhn Littles hat das Thema jetzt in Wissenschaft und formale Institutionen eingeschlichen.

Oxford Philosoph Nick Bostrom startete es alle im Jahr 2002 mit seinem einflussreichen Vortrag "existenzielle Risiken: Analyse der menschlichen Aussterben Szenarien." Bostrom argumentiert, dass die Beschleunigung der technologischen Fortschritts unserer Spezies in eine gefährliche verlagert – und potenziell unüberwindbar – neue Phase mit Bedrohungen, die "könnte dazu führen, dass unsere vom Aussterben bedroht oder zerstören das Potential der Erde stammenden Leben." Seit dem Papier erscheinen ist der Begriff "existenzielle Risiken" stetig in allgemeinen Gebrauch gekommen.

Sir Martin Rees, einen TED-Vortrag: können wir verhindern, dass das Ende der Welt?

Im Jahr 2003 geschätzten Physiker Sir Martin Rees ein Buch über das Thema: unsere letzte Stunde: ein Wissenschaftler Warnung: wie Terror, Fehler und Umweltkatastrophe Menschheit bedrohen die Zukunft in diesem Jahrhundert auf der Erde und darüber hinaus. Ein weiteres einflussreiches Buch kam im Jahr 2008 Global Catastrophic Risks, die von Bostrom und Milan M. Cirkovic bearbeitet wurde.

In Großbritannien existentielle Risiken wird von Philosophen, Wissenschaftlern und Futuristen in Oxford Future of Humanity Institute studiert und an der University of Cambridge frisch gebackenen Mitte für die Studie der existenziellen Gefahr. Das Thema hat nicht wirklich viel Traktion an anderer Stelle gewonnen, aber es ist ein Anliegen des US-amerikanischen Instituts für Ethik und Zukunftstechnologien.

Hawking ist also eindeutig nicht allein. Aber er passiert, eine Alleinstellung von wo er seine Warnungen über die Zukunft zu verkünden und potenziell beeinflussen unsere Antwort zu besetzen. Das Problem ist, so hoch angesehene Zahl ständig diese düsteren Proklamationen Auslauf ohne auch praktikable Lösungen anzubieten. Auf diese Weise ist er eine defätistische Haltung und sogar ein gewisses Maß an Menschenverachtung verewigen.

Natürlich ist es wichtig, das Wort raus, bevor es zu spät, aber es nicht reicht, nur der Überbringer schlechter Nachrichten sein. Voran, hoffen wir, dass er das große Gehirn seiner verwenden kann, um etwas produktiver einfallen lassen.

[Telegraph | BBC]

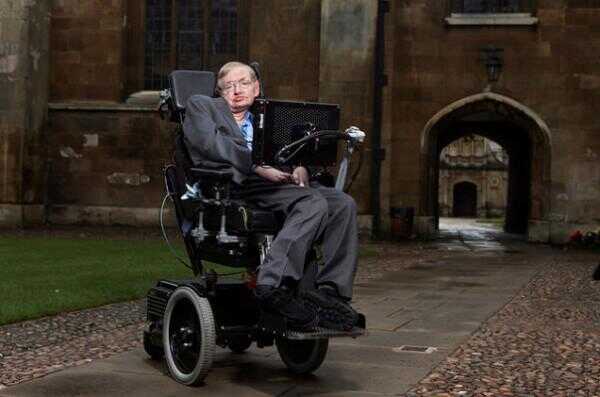

Oberes Bild: Illustration von Jim Cooke, Foto: AP; mittleres Bild: Lwp Kommunikáció