Eine neue Studie von Facebook zeigt nur wie viel es filtert, was Sie sehen

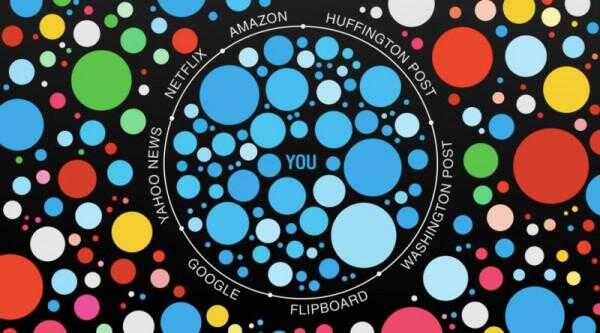

Vor ein paar Jahren hielt ich einen Vortrag über wie Algorithmen und social Media prägen, was wir wissen. Ich konzentrierte mich auf die Gefahren der "Filterblase" — das personalisierte Universum der Informationen, die es in unseren Feed macht — und argumentiert, dass Nachrichten filtern Algorithmen einzugrenzen, was wir wissen, rund um uns Informationen, die dazu neigt zu unterstützen, was wir schon glauben. Das Bild oben ist die Hauptfolie.

In dem Gespräch rief ich Mark Zuckerberg, Bill Gates, und Larry und Sergey bei Google (einige davon waren angeblich im Publikum) um sicherzustellen, dass ihre Algorithmen zu priorisieren, gegenläufige Meinungen und Nachrichten, die wichtig ist, nicht nur die Sachen, die beliebtesten oder am meisten selbst überprüfen. (Ich schrieb auch ein Buch über das Thema, wenn Sie so etwas mögen.)

Heute hat Facebook Daten-Science-Team Teil der "filter Bubble" Theorie auf die Probe gestellt und veröffentlicht die Ergebnisse in der Wissenschaft, ein Top Peer-Review-Fachzeitschrift. Eytan Bakshy und Solomon Messing, zwei der Co-Autoren waren gnädig genug, zu erreichen und informieren mich ausführlich.

Also, wie halten die "filter Bubble" Theorie?

Hier ist das Ergebnis: Ja, mit Facebook Mitteln Sie neigen dazu, deutlich mehr Nachrichten zu sehen, das ist beliebt bei Menschen, die Ihre politischen Überzeugungen zu teilen. Und es ist eine echte und wissenschaftlich "filter erhebliche Bubble-Effekt" – der Facebook-Newsfeed-Algorithmus wird insbesondere neigen dazu, Nachrichten zu verstärken, die Ihre politischen Compadres begünstigen.

Dieser Effekt ist kleiner als man denkt (und kleiner als ich gedacht hätte.) Im Durchschnitt sind Sie ca. 6 % weniger Inhalte sehen, die die anderen politischen Seite begünstigt. Wer Sie mit Fragen ein gutes Stück mehr als der Algorithmus befreundet sind.

Aber es ist auch nicht unbedeutend. Der Algorithmus spielt beispielsweise für selbsternannte Liberalen auf Facebook eine etwas größere Rolle in was sie als ihre eigenen Entscheidungen über das, was zum Anklicken sehen. Es ist ein 8 % Rückgang übergreifende Inhalte aus der Algorithmus vs. ein Rückgang um 6 % aus liberalen Möglichkeiten was zu klicken. Für die Konservativen, die Filter Bubble-Effekt ist etwa 5 %, und klicken Sie auf Effekt ist etwa 17 % – ein ziemlich anderes Bild. (Ich habe einige andere interessante Erkenntnisse aus der Studie hier gezogen.)

In der Studie Bakshy, Messing und Facebook Datenwissenschaftler Lada Adamic Schwerpunkt der 10 Millionen Facebook-Nutzer, die sich politisch beschriftet sind. Sie verwendeten Schlüsselwörter "Hard News" Inhalt zu unterscheiden – ca., sagen wir, Politik oder Wirtschaft – aus "Soft News" über die Kardashians. Und jeder Artikel eine Bewertung basierend auf die politischen Überzeugungen der Menschen, die es gemeinsam zugeordnet. Wenn nur selbsternannte Liberalen einen Artikel geteilt, galt es sehr Liberal ausgerichtet. (Es gibt einige Einschränkungen beachtenswert auf diese Methode, die ich unten hervorgehoben.)

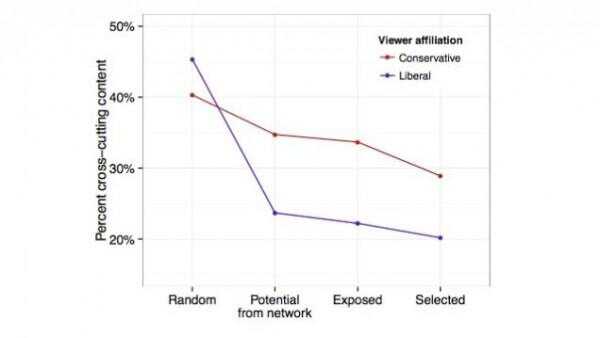

Dann sah sie an, wie oft Liberalen sahen in konservativ ausgerichteten Inhalten und umgekehrt. Hier ist die zentrale Tabelle:

Erste ("Random"), dies zeigt der Gesamtanteil von Hard News Links auf Facebook, wenn jeder eine Zufallsstichprobe von alles sah. Liberalen konservativen Inhalt 45 % sehen würde, und konservativen sähe etwa 40 % liberale Inhalte. Sekunde ("Potential von Netzwerk"), den durchschnittlichen Anteil der übergreifenden Artikel geschrieben von Freunden eine Person zu sehen. Dritten ("ausgesetzt") ist der Prozentsatz, den sie tatsächlich sah – hier spielt die Algorithmus. Und vierten ("Selected") ist der Prozentsatz, den sie tatsächlich angeklickt.

Eine wichtige Sache zu beachten: die Steigung der Linie ausfällt. In jeder Phase sieht die Menge an übergreifenden Inhalten, dass man abnimmt. Die steilste Reduktion kommt aus, wer seine Freunde sind, das macht Sinn: Wenn du nur liberale Freunde hast, wirst du eine dramatische Reduzierung der konservative News sehen. Aber der Algorithmus und Menschen Entscheidungen darüber, was zu klicken wichtig ein gutes Geschäft.

In seiner Reichweite Presse Facebook hat betont, dass "individuelle Auswahl" mehr zählt als Algorithmen tun –, dass Menschen Freundschaftsgruppen und Aktionen, um sich vor Inhalten schützen sie nicht zustimmen sind die Hauptschuldigen in jedem sprudelt vor sich geht. Ich denke, das ist eine Übertreibung. Sicherlich, wer deine Freunde sind sehr wichtig im Bereich social Media. Aber die Tatsache, dass der Algorithmus Effekt Verengung der ist fast so stark wie unsere eigenen Vermeidung von Ansichten, die, denen wir ablehnen, legt nahe, dass es tatsächlich eine ziemlich große Sache ist.

Es ist eine andere wichtige Stück herausziehen. The Filter Bubble war wirklich über zwei Anliegen:, dass Algorithmen helfen würde Leute umgeben sich mit Medien, unterstützt, was sie schon glauben, und Algorithmen werden tendenziell nach unten-die Art der Medien Rang, das Nötigste in einer Demokratie – News und Informationen zu den wichtigsten sozialen Themen.

Während dieser Studie konzentrierte sich auf das erste Problem, es bietet auch einen Einblick in die zweite, und die Daten dort über. Nur 7 % des Inhalts Leute klicken Sie auf auf Facebook ist "Hard News". Das ist eine erschreckend kleine Stück des Puzzles. Und es deutet darauf hin, dass "weiche" Nachrichten des Krieges für Aufmerksamkeit in den sozialen Medien gewinnen kann – zumindest vorerst.

Das Gespräch über die Auswirkungen und die Ethik der Algorithmen ist unglaublich wichtig. Schließlich vermitteln sie mehr und mehr von dem, was wir tun. Sie leiten einen zunehmenden Anteil unserer Entscheidungen – wo kann man Essen, wo man übernachten kann, wer mit schlafen und was zu lesen. Von Google zu Yelp auf Facebook gestalten sie was wir wissen.

Jeder Algorithmus enthält eine Sicht auf die Welt. Wohl, das ist, was ein Algorithmus ist: eine Theorie wie ein Teil der Welt sollte funktionieren, ausgedrückt in Mathematik oder Code. Also zwar wäre es toll, dass sie von außen besser zu verstehen, ist es wichtig zu sehen, Facebook in diesem Gespräch treten. Desto mehr können wir wie diese Algorithmen arbeiten und welche Auswirkungen sie desto mehr sind wir in der Lage haben, unsere eigenen Informationen Schicksal bestimmen, zu befragen.

Einige wichtigeren Einschränkungen der Studie

, Dass ideologische tagging Mechanismus bedeutet nicht, es bedeutet, wie es aussieht. Wie die Autoren der Studie betonen würde – aber viele Leute vermissen — dies ist ein Maß dafür wie Partisan voreingenommen die Nachrichtenquelle Artikel oder Nachrichten ist nicht. Vielmehr ist es ein Maß von denen Artikel neigen, die meisten von einer ideologischen Gruppe oder anderen geteilt werden. Wenn konservative wie Einhörner und gibt es Inhalte, die den "Hard News" Filter über Einhörner übergibt, zeigen, dass werde sich als konservativ ausgerichteten – obwohl der Zustand der Einhorn-Diskurs in den USA nicht parteiisch ist.

Es ist schwer, etwas durchschnittlich, die ständig verändert, und für jeden anders. Dieses Ergebnis ist im Durchschnitt während dieses Zeitraums (7. Juli 2014, zum 7. Januar 2015) wahr. Das ist eine Zeit, als Facebook Video und Trending wurde viel mehr im Vordergrund – und wir können nicht sehen, welchen Effekt das hatte. (Ich glaube, die Autoren sagen würde, dass der Befund ziemlich robust ist, aber angesichts Facebooks ständige Neuerfindung, ich eher skeptisch bin.)

Dieser misst nur 9 % der Facebook-Nutzer, die ihrer politischen Zugehörigkeit zu melden. Es ist davon auszugehen, dass sie ein bisschen anders sind – vielleicht mehr Partisan oder mehr Aktivist-y — von der durchschnittliche Facebook-Leser.

Es ist wirklich schwer, "individuelle Auswahl" und die Arbeitsweise des Algorithmus zu trennen. All die Filterwirkung ist wohl eine Funktion eine individuelle Entscheidung: die Wahl, um Facebook zu verwenden. Auf der anderen Seite reagiert der Algorithmus auf das Nutzerverhalten auf viele verschiedene Arten. Es gibt hier eine Feedbackschleife, die für verschiedene Arten von Menschen erheblich abweichen können.

In meiner bescheidenen Meinung nach ist dies gute Wissenschaft, aber weil es von Facebook Wissenschaftlern, es ist nicht reproduzierbar. Die Forscher auf dem Papier sind intelligente Männer und Frauen, und mit den oben genannten vorbehalten, die Methode ist ziemlich solide. Und sie machen eine Menge von Daten und Algorithmen zur Überprüfung zur Verfügung. Aber am Ende des Tages, Facebook bekommt zu entscheiden, welche Studien frei zu bekommen, und es ist nicht möglich, dass eine unabhängige Forscher, diese Ergebnisse ohne Facebook Genehmigung zu reproduzieren.

Eli Pariser ist der Autor der New York Times-Bestseller Die Filter-Blase: Was verbirgt das Internet von Ihnen und Mitbegründer des Upworthy, eine Website, die Aufmerksamkeit auf wichtige soziale Themen gewidmet. Er ist am @Elipariser auf Twitter. Diesen Beitrag ursprünglich erschienen auf Medium und wird hier mit freundlicher Genehmigung veröffentlicht.