Roboter könnten Turing-Test Hack durch Schweigen

Der Turing-Test, die Quintessenz Auswertung entwickelt, um festzustellen, ob ein Computer oder ein Mensch ist einen fatalen Fehler haben kann, schlägt neue Forschung.

Der Test kann momentan nicht feststellen, wenn eine Person zu einem anderen Menschen spricht oder ein Roboters, wenn die Person verhört einfach wählt zu leise, neue Forschung zeigt bleiben.

Während es keine Nachricht, dass der Turing-Test Mängel hat, die neue Studie unterstreicht wie begrenzt der Test ist für die Beantwortung von tiefer Fragen über künstliche Intelligenz, sagte Studie Co-Autor Kevin Warwick, Informatiker an der Coventry University in England. [Super-intelligenten Maschinen: 7 Roboter Futures]

"Als"Maschinen werden immer mehr und intelligenter, ganz gleich, ob sie eigentlich denken und ob wir müssen ihnen Aufgaben beginnen, sehr ernste Fragen zu werden,"sagte Warwick Live Science. "Offensichtlich ist der Turing-Test nicht derjenige, der sie necken kann."

Nachahmung Spiel

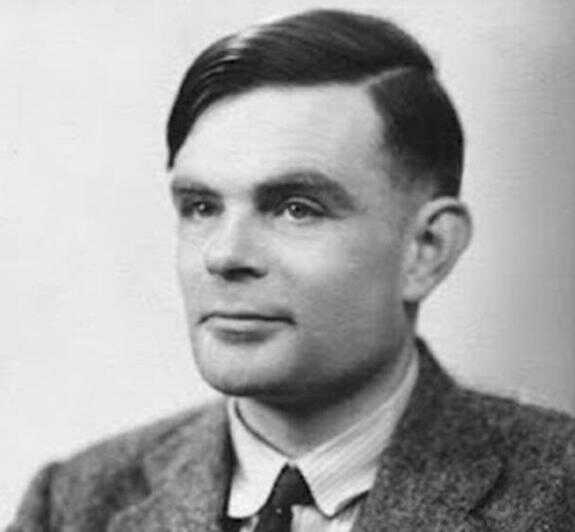

Die mittlerweile berühmten Turing-Test wurde erstmals beschrieben von britischen Informatiker Alan Turing 1950 Fragen wann und wie zu bestimmen, ob Maschinen empfindungsfähig sind. Die Frage, ob Maschinen denken können, argumentierte er, ist falsch: Wenn sie als Mensch in genannte er die Nachahmung Spiel so abgehen können, das ist gut genug.

Der Test ist einfach: setzen eine Maschine in einem Raum, einen menschlichen Vernehmer in einem anderen, und sie sprechen miteinander über eine textbasierte Konversation. Wenn die Abfrage die Maschine als Nichtmenschen identifizieren kann, versagt das Gerät; Ansonsten geht es.

Die einfache und intuitive Test ist sehr einflussreich in der Philosophie der künstlichen Intelligenz geworden. Aber von Anfang an, fanden Forscher Fehler im Test. Zum einen das Spiel konzentriert sich auf Täuschung und übermäßig konzentriert sich auf Unterhaltung als die Metrik der Intelligenz.

Zum Beispiel gab in den 1970er Jahren eine frühe Sprachverarbeitung Programm namens ELIZA Turing Test Richter einen Lauf für ihr Geld durch Nachahmung eines Psychiaters Trick Fragen an den Fragesteller zurück zu reflektieren. Und im Jahr 2014 Forscher täuschen einen menschlichen Vernehmer mit einer "Chatbot" namens Eugene Goostman, die entworfen wurde, um als einem 13 Jahre alten ukrainischen Jungen darstellen.

Recht auf Aussageverweigerung

Warwick war Turing-Tests zum 60. Jahrestag des Todes von Turings organisieren, wenn er und sein Kollege Huma Shah, auch ein Informatiker an der Coventry University, etwas seltsames bemerkt: gelegentlich einige AI Chatbots brach und schwieg und verwirrend die Vernehmungsbeamten.

"Wenn sie taten so, der Richter, bei jeder Gelegenheit nicht konnte sagen es eine Maschine war", sagte Warwick Live Science. [Die 6 erstellt seltsamsten Roboter jemals]

Nach den Regeln des Tests wenn der Richter die Maschine endgültig identifizieren kann besteht dann die Maschine den Test. Durch diese Maßnahme eine Stille Bot oder sogar einen Felsen den Turing-Test bestehen könnte, sagte dann, Warwick.

Auf der anderen Seite bekommen viele Menschen ungerecht als AI, geteert Warwick sagte.

"Sehr oft Menschen zu tun bekommen klassifiziert als eine Maschine, weil einige Menschen dumme Sachen sagen," sagte Warwick. In diesem Szenario Wenn der Maschine Konkurrent einfach still, blieb es standardmäßig gewinnen würde, fügte er hinzu.

Bessere tests

Die Ergebnisse weisen auf die Notwendigkeit für eine Alternative zu den Turing-Test, sagte Hector Levesque, ein emeritierter Informatik-Professor an der University of Toronto in Kanada, der nicht mit der neuen Forschung beteiligt war.

"Die meisten Menschen erkennen, dass wirklich, es ist ein Test, um festzustellen, ob Sie ein Vernehmer täuschen können," sagte Levesque Leben Wissenschaft. "Es ist nicht allzu verwunderlich, dass es gibt verschiedene Möglichkeiten der täuschen Vernehmungsbeamten, die nicht viel mit AI oder Intelligenz zu tun haben."

Levesque hat eine alternative Testmethoden entwickelt, die er die Winograd-Schema nannte (benannt nach Informatikforscher Terry Winograd, wer zuerst einige der Fragen, die im Test lassen einfallen).

Die Winograd-Schema stellt AI eine Reihe von Fragen, die eindeutig richtige Antworten haben. Beispielsweise könnten sie Fragen: "die Trophäe in den braunen Koffer passten einfach nicht weil es zu groß (klein) war. "Was war zu groß (klein)?"

Diese Abfragen sind weit entfernt von den reichen Diskussionen von Shakespeares Sonetten, dass Turing statt zwischen AI und Menschen.

"sie sind banal und sicherlich nicht annähernd so auffällig wie ein richtiges Gespräch mit jemandem haben", sagte Levesque.

Doch erfordert richtig beantworten ein Verständnis der Sprache, räumliche Argumentation und Kontext, um herauszufinden, dass Trophäen in Koffer passen.

Und noch andere vorgeschlagene Alternativen zu den Turing-Test auf verschiedene Aspekte der menschlichen Intelligenz, wie Kreativität konzentriert haben.

Lovelace-Test zur Messung von Kreativität erfordert einen Roboter ein Stück der künstlerischen Arbeit in einem bestimmten Genre zu erstellen, die Abhängigkeiten von einem menschlichen Richter gegeben erfüllt. Aber auch in diesem Bereich gewinnen Roboter auf Sterbliche: Anfang dieses Jahres die Forscher geschaffen, eine "neue Rembrandt" Malerei im Stil des niederländischen Meisters, mit künstlicher Intelligenz und Roboter Maler.