Verwandeln Sie sich in eine emotionslose Roboter mit Googles neue Messaging-App

In diesen Tagen ist denken von Möglichkeiten zur Kommunikation mit Freunden und Familie einfach zu schwierig. Dank Google wird Software, die jetzt für uns tun.

Gestern, Google enthüllt Allo, eine neue Messaging-app, die mit Google-Assistent kommt erbaut. Es hat einige sehr nette Features, aber es ist unklar, ob Allo Marktführer wie WhatsApp oder iMessage übertreffen kann.

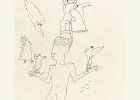

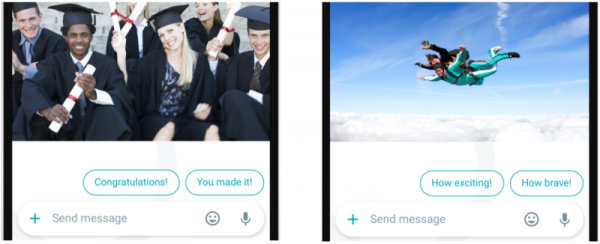

Es ist ein Merkmal, das wirklich raus, aber kriecht: Foto Antwort. Die Prämisse des Foto-Antwort ist, dass Software Fotos geschickt, um Sie zu analysieren und auto - erzeugen entsprechende Antworten, einen Computer für Sie denken zu lassen.

Es gibt keinen Zweifel, dass diese Technologie ist beeindruckend. Die Tatsache, das Wetter app herausfinden kann ich freue mich auf ein Bild von einem Baby oder einem Haufen Scheiße – und dann fast sofort eine Antwort zu generieren, ist verrückt.

Aber Mann, es fühlt sich komisch. Foto Antwort entfernt das menschlichste Element eines Gesprächs lassen einen Algorithmus für Sie emote. Und was ist mit der Person, die das Bild sendet? Wie werden sie wissen, ob die Antwort erhielten sie war eine echte, herzliche, eingegeben-Out Antwort und nicht nur das, was eine app vorgeschlagen?

Die Entwickler hinter dieser Funktion schrieb einen Blog-Post gestern ihre rationale für das neue Feature zu erklären, und es nicht viel tun, um die Funktion weniger Roboter scheinen zu machen:

Wir nutzen Googles Bilderkennungstechnologie, entwickelt von unserem Team maschineller Wahrnehmung zu assoziieren Bilder mit semantischen Einheiten – Menschen, Tiere, Autos, etc.. Dann wenden wir ein gelernt Maschinenmodell dieser anerkannten Unternehmen, der tatsächliche natürlicher Sprache Antworten zugeordnet. Unser System produziert Antworten für Tausende von Entitätstypen, die von einer Taxonomie gezeichnet sind, die ist eine Teilmenge von Googles Knowledge Graph und möglicherweise auf unterschiedliche Granularität Ebenen. Beispielsweise wenn Sie ein Foto eines Hundes erhalten, kann das System erkennen, dass der Hund ist eigentlich ein Labrador und deuten darauf hin, "dass Lab Liebe!". Oder erhalten ein Foto von einem Nudelgericht, erkennt möglicherweise die Art von Teigwaren ("Yum Nudeln!") und sogar die Küche ("Ich liebe italienisches Essen!").

Also, dies wirft einige Fragen auf. Es sind Bilder, die Google auto wird nicht generieren eine Antwort für? Können sie sagen, der Unterschied zwischen einer Hochzeit und ein Todesfall und erzeugen dann eine angemessene Reaktion?

Während der Laufzeit Foto Antwort erkennt Personen auf dem gemeinsamen Foto und löst Reaktionen für die Entitäten. Das Modell, das natürliche Sprache Antworten Entitäten zugeordnet wird erlernt, offline mit Expander, ist eine groß angelegte Graph-basierte semi betreute Lernplattform bei Google. Wir bauten eine massive ein Diagramm, wo Knoten Fotos, semantische Einheiten und textuellen Reaktionen entsprechen. Kanten im Graphen zeigen, ein Unternehmen für ein Foto erkannt wurde, als eine konkrete Antwort für ein Foto und visuelle Ähnlichkeiten zwischen Fotos gegeben wurde. Einige Knoten werden "bezeichnet," und wir lernen Verbände für die unbeschrifteten Knoten durch die Verbreitung von Label-Informationen über das Diagramm.

Dies ist eine interessante Technologie, aber es ist ein bisschen zu viel für mich. Es ist wahrscheinlich ein Zeichen der Zeit, dass Software, die sofort als ein cooles zukünftige Prozesse und Formulare Emotionen und Reaktionen für uns gefeiert. Aber denken Sie daran: diese Software ist auch eindringenden einige intime und persönliche Aspekte unseres Lebens.