Gehirn-Lesegeräte konnte die Tastatur töten.

Die QWERTY-Tastatur Computer Eingabe von mehr als 40 Jahre lang beherrscht hat, aber ein neuer Durchbruch, der menschlichen Denkens in digitalen Text übersetzt kann der Anfang vom Ende für Handbearbeitung Wort buchstabieren. Ein erster Schritt in Richtung dieser Gedankenlesen gekommen mit Gehirn-Scans um zu bestimmten Gedanken mit bestimmte Wörter zu identifizieren.

Die fMRT-Hirnscans zeigten bestimmte Muster der menschlichen Hirnaktivität, ausgelöst durch das Nachdenken über physische Objekte, wie ein Pferd oder ein Haus. Forscher auch die Gehirn-Scans verwendet, um die Gehirnaktivität geteilt durch Wörter in Bezug auf bestimmte Themen zu identifizieren – Nachdenken über "Auge" oder "Fuß" zeigte Muster ähnlich denen der anderen Wörter in Bezug auf Körperteile.

"Die Grundidee ist, dass jeder Gegenstand auf jemandes Geist ist – nicht nur Themen oder Konzepte, sondern auch Emotionen, Pläne oder sozial orientierten Gedanken – spiegelt sich letztlich in das Muster der Aktivität in allen Bereichen seines Hirns", sagte Matthew Botvinick, Psychologe an der Princeton University Neuroscience Institute.

Gehirn-Lesegeräte würde wahrscheinlich zuerst helfen, Gelähmte Menschen wie Physiker Stephen Hawking, aber noch nicht seit Jahren passieren, warnte Botvinick. Es gibt auch das Problem, dass Gehirn-Scan-Technologien mehr tragbar, wenn Bürger hoffen, einen Schuss zu befreien, die ihre Hände vom tippen zu bekommen.

Botvinick stellte noch eine Zukunft, wo solche Technologie geistige Inhalte über nicht nur Objekte, sondern auch Menschen, Aktionen, abstrakte Konzepte und Beziehungen übersetzen könnte.

Eine bestehende Technologie ermöglicht Patienten mit kompletten Lähmung – bekannt als locked-in Syndrom – ihre Augen verwenden, um einen Buchstaben Wörter bilden gleichzeitig auswählen. Ein weiteres Labor-Prototyp ermöglicht Patienten, synthetisierte Stimmen machen, indem Sie ihre Gedanken bestimmte Vokale zu erstellen, auch wenn sie noch zusammenhängende Wörter bilden können. Aber wirklich direkten Gedanken-zu-Wort-Übersetzung bleibt unerreichbar.

Das ist, wo die aktuelle Arbeit ins Spiel kommt. Botvinick arbeitete zunächst mit Francisco Pereira, Postdoktorand Princeton und Greg Detre, ein Forscher, in Princeton, promovierte über die Verwendung der Aktivität des Gehirns Muster, um Bilder zu rekonstruieren, die Freiwilligen bei einem Gehirn-Scan angezeigt. Aber die Forschung bald inspiriert sie zu versuchen, bestimmte Elemente in Wörtern anstatt Bilder zum Ausdruck zu bringen.

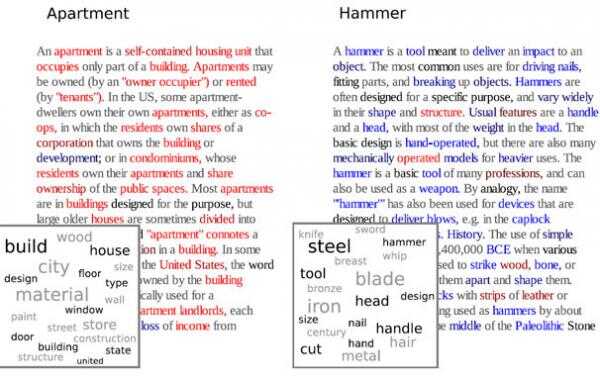

Erstens verwendet sie ein Princeton entwickelten Computerprogramm um zu kommen mit 40 möglichen Themen auf Wikipedia-Artikeln, die mit solchen Themen verbundenen Wörter enthalten. Sie erstellt dann ein Farbleitsystem um Wahrscheinlichkeit bestimmter Wörter, die auf ein Objekt, das ein freiwilliger gedacht, während des Lesens eines Wikipedia-Artikels bei einem Gehirn-Scan zu identifizieren.

In einem Fall zeigte ein mehr rotes Wort, dass eine Person eher zugeordnet "Kuh." Eine helle blaue Wort vorgeschlagen eine starke Verbindung zu "Karotte", und schwarze oder graue Worte hatte keine bestimmte Zuordnung.

Dennoch gibt es Grenzen. Der Forscher können feststellen, ob Teilnehmer hatte Gemüse gedacht, aber können nicht unterscheiden zwischen "Zuckerbrot" versus "Sellerie." Sie hoffen, ihre Methode in Zukunft empfindlicher auf solche Details zu machen.

Diese Geschichte wurde von InnovationNewsDaily, Schwester Website bereitgestellt, um LiveScience. Folgt InnovationNewsDaily auf Twitter @News_Innovation oder auf Facebook.