Supercomputer "Titans" Gesicht enorme Energiekosten

Lager-Größe Supercomputer kostet $ 1 Million bis $ 100 Millionen können aus normalen Laptops und Tablets als griechische unsterblichen auf dem Olymp so weit entfernt scheinen. Doch könnte beim nächste große Sprung im Supercomputing nicht nur US-Wissenschaft und Innovation zu verwandeln, sondern auch viel mehr Rechenleistung in den Händen der Verbraucher setzen.

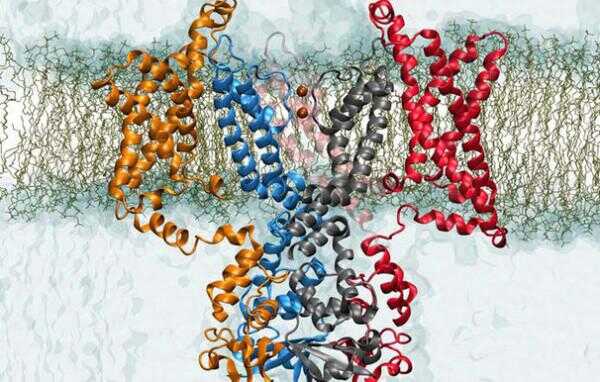

Die nächste Generation der "Exascale" Supercomputer 1000000000 Milliarden Berechnungen pro Sekunde durchführen konnte – 1000-mal besser als die leistungsfähigsten Supercomputern heute. Solcher Supercomputer könnte genau Verbrennungsmotoren von Autos, Flugzeug-Triebwerken und sogar nukleare Fusionsreaktoren zum allerersten Mal simulieren. Sie könnten auch "SimEarth" Modelle des Planeten bis auf die 1 Kilometer-Skala (im Vergleich zu 50 oder 100 km heute) oder Simulationen von lebenden Zellen, die die molekularen, chemischen, genetischen und biologischen Ebenen auf einmal aufnehmen.

"So gut wie allen Bereichen der Wissenschaft heute von Theorie, Experiment und Simulation, angetrieben wird", sagte Steve Scott, chief Technology Officer bei der Tesla Business Unit bei NVIDIA. "Wissenschaftler bedienen von Maschinen eine virtuelle Erfahrung um zu verstehen, die Welt um uns herum zu laufen."

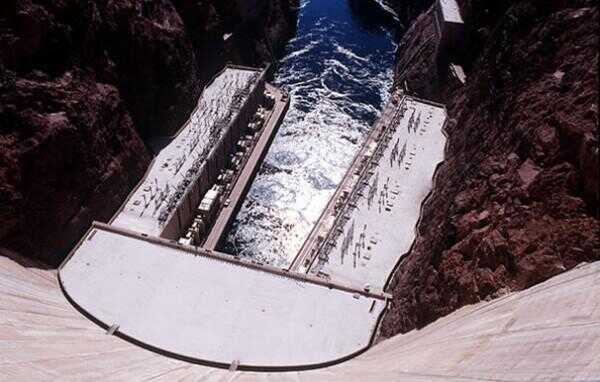

Aber die Zukunft des Supercomputing hat eine unglaubliche Energie Kosten – nur ein Exascale-Supercomputer müsste die Kraft entspricht der maximalen Leistung des Hoover-Staudamms. Um dieses Problem zu umgehen, müssen Informatikern und Mathematikern eine völlig neue Art der Rechnerarchitektur träumen, die Energieeffizienz Preise.

Forscher versammelt, um die Herausforderungen im Rahmen eines Workshops des Instituts für Informatik und experimentelle Forschung in der Mathematik an der Brown University im Januar statt.

"Wir haben erreicht, dass den Punkt, wo vorhandener Technologie über gedauert hat, soweit wir mit aktuellen Modelle gehen können", sagte Jill Pipher, Direktor des ICERM. "Wir haben zugenommen Rechenleistung von 1.000 Falte alle paar Jahre für eine Weile jetzt, aber jetzt haben wir die Grenzen erreicht."

Wir können sie wieder aufzubauen.

Informatik-Ingenieure haben es geschafft, die doppelte Anzahl von Transistoren in den gleichen Mikrochip-Raum alle paar Jahre quetschen – ein Trend, bekannt als das Moore'sche Gesetz — wie sie Stromanforderungen stabil gehalten. Aber selbst wenn sie genügend Transistoren auf einen Mikrochip Exascale computing ermöglichen squeeze, die benötigte Leistung wird zu groß.

"Wir sind eine Welt eingeschränkt betreten nicht durch wie viele Transistoren können wir einen Chip setzen oder ob wir Uhr können sie so schnell wie möglich, aber durch die Hitze, die sie erzeugen," Scott erzählt InnovationNewsDaily. "Der Chip würde verbrennen und effektiv schmelzen."

Das erfordert eine radikale Neugestaltung der Rechnerarchitektur, es viel energieeffizienter zu machen. Das US-Department of Energy will einen Weg finden, eine Exascale-Supercomputer 2020 zu machen, die weniger als 20 Megawatt Leistung verwenden würden – etwa 100 mal weniger als der Hoover-Staudamm maximale Leistung von 2.074 Megawatt, die heute erforderlich wären.

Ändern Computer-Architektur erfordert auch eine Neufassung der Software-Programme, die auf heutigen Computern ausgeführt. Angewandter Mathematiker fällt die Aufgabe herauszufinden, dass Puzzle.

"Wenn der Code geschrieben ist, ist es für Computer wo Speicher billig ist, geschrieben" Pipher erklärt. "Nun, wenn Sie diese neuen Maschinen erstellen, wirst du musst versuchen, Programme zu schreiben, auf unterschiedliche Weise."

You say CPU, ich sage GPU

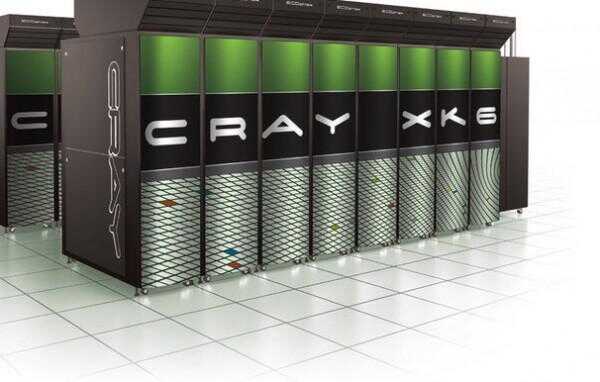

Heutigen schnellsten Supercomputer ähneln Hunderte von Kühlschrank-Größe Schränke verpackt in großen Räumen. Jeder der diese Schränke bietet Platz für mehr als 1.000 Prozessoren (CPUs), wo eine CPU etwa das "Gehirn" entspricht, das die Software-Programm-Anweisungen in einem einzigen Laptop durchführt.

Die neueste Generation der Petascale Supercomputer (1 Billiarde Berechnungen pro Sekunde fähig) bekommen hat, mit Tausenden von CPUs untereinander vernetzt. Aber jede CPU soll ein paar Aufgaben laufen so schnell wie möglich mit weniger Rücksicht auf Energieeffizienz, und also nicht CPUs für Exascale-Supercomputer.

Eine vielversprechende Lösung kommt von einer Firma, die auch unter den PC-Spieler bekannt. Über ein Jahrzehnt erstellt NVIDIA Grafik Recheneinheiten (GPUs), die sich auf viele Aufgaben effizient läuft – eine Notwendigkeit für die reichen Graphiken ein video oder Spiel spielen auf einem Computer erstellen.

Die Energieeinsparung kann riesig sein, wenn eine GPU fast 8 mal weniger Energie als eine CPU pro Computer Berechnung oder Anweisung verwendet.

"GPUS mit Energie-Effizienz im Auge zuerst entworfen wurden nicht ausgeführt eine einzelne Aufgabe schnell,", sagte Scott. "Das ist, warum sie sind einzigartig qualifiziert für diese Herausforderung. Wir müssen sehr viel effizienter über wie viel mehr Arbeit, die wir pro Watt [der Energie] tun können."

NVIDIA GPUs befinden sich bereits in drei der schnellsten Supercomputer der Welt, einschließlich Chinas Tianhe-1A auf dem zweiten Platz. GPUs stärkt auch die $ 100 Millionen Titan Supercomputer für die Installation am Oak Ridge National Laboratory in Oak Ridge, Tennessee geplant – ein Petascale-Supercomputer, die wieder einmal die USA nach Hause, der weltweit schnellsten Supercomputer machen könnte.

Bessere Computer für alle

Der Weg zum Exascale computing wird nicht einfach sein, aber NVIDIA hat einen Zeitplan für die Erstellung von neuen Generationen von GPUs, die im Jahr 2018 zu solch einem Supercomputer führen können. Das Unternehmen "Kepler" GPU wird voraussichtlich 5 Milliarden Berechnungen pro Watt Energie ausgeführt, wenn es im Jahr 2012 debütiert, während die nächste Generation "Maxwell" GPU 14 Milliarden Berechnungen pro Watt bis 2014 durchführen könnte.

Aber NVIDIA nicht in High-Performance-computing nur um eine Handvoll von riesigen Supercomputer bauen jedes Jahr investieren – vor allem, wenn jede Generation von GPUs kostet etwa $ 1 Milliarde zu entwickeln. Stattdessen sieht es die Supercomputer Investition führt zu leistungsfähigeren Computern für einen viel größeren Pool von Kunden unter den Unternehmen und Privatpersonen.

Die gleichen Mikrochips in Supercomputern können im Inneren des Heimcomputers Gamer, Scott wies darauf hin, Ende. In diesem Sinne jede neue Generation von leistungsfähigeren Chips schließlich stellt mehr Rechenleistung zur Verfügung für billiger – bis zu dem Punkt, wo die seltensten Supercomputer gewöhnlicheren morgen heute können.

Das Ergebnis ist weniger alltäglich als außergewöhnliche für Wissenschaft und Innovation voran.

"Wenn Sie ein Petascale System für $100.000 zu bauen, es beginnt immer sehr erschwinglich für selbst kleine Abteilungen an einer Universität oder auch kleine Gruppen in der Privatwirtschaft," sagt Scott.

Wurde diese Geschichte von InnovationNewsDaily, eine Schwester Website LiveScience zur Verfügung gestellt. Sie können InnovationNewsDaily Senior Writer Jeremy Hsu folgen auf Twitter @ScienceHsu. Folgen Sie InnovationNewsDaily auf Twitter @News_Innovation, oder auf Facebook.