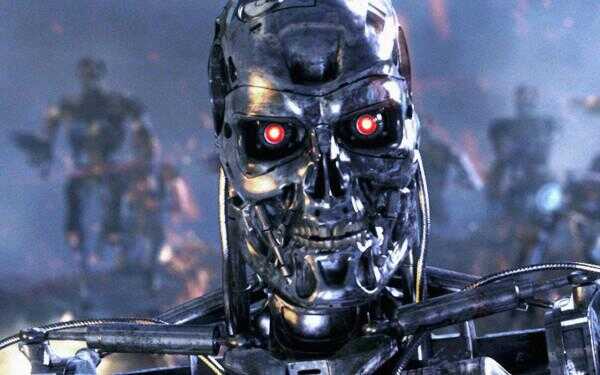

Killer-Roboter brauchen Regulierung Experte warnt

Es ist ein vertrautes Thema in Hollywood-Blockbuster: Wissenschaftler entwickelt Roboter, Roboter wird fühlenden, Roboter versucht, die Menschheit zu vernichten. Aber mit scheinbar Sci-Fi-technologische Fortschritte Tippbetrieb näher an der Realität, künstliche Intelligenz und Robotik-Experten stellen eine wichtige Frage: sollten sie für oder gegen die Entwicklung von tödlichen, autonomen Robotern?

"Technologien haben einen Punkt, an dem der Einsatz solcher Systeme ist, erreicht – praktisch, wenn auch nicht rechtlich – machbar innerhalb von Jahren, nicht Jahrzehnte" Stuart Russell, Informatiker und künstliche Intelligenz (KI) Forscher von der University of California, Berkeley, schrieb in einem Kommentar veröffentlicht heute (27. Mai) in der Zeitschrift Nature. Diese Waffen "als die dritte Revolution in der Kriegsführung, nach Schießpulver und Atomwaffen, beschrieben haben", schrieb Russell.

Tödliche Autonome Waffensysteme könnte finden und ihre Ziele ohne menschliches Zutun anzugreifen. Zum Beispiel solche Systeme wären bewaffneten Drohnen, die gesendet werden, um Feinde in einer Stadt zu töten, oder Schwärme von autonome Boote an Schiffe anzugreifen. [Die 6 erstellt seltsamsten Roboter jemals]

Tödlichen Roboter

Einige Leute argumentieren, dass Roboter möglicherweise nicht in der Lage, zwischen feindlichen Soldaten und Zivilisten, zu unterscheiden und so möglicherweise versehentlich töten oder unschuldige Menschen verletzen. Noch andere Kommentatoren, dass Roboter kann dazu führen, dass weniger Kollateralschäden als menschlichen Soldaten, auch nicht unter menschliche Gefühle wie Aggression. "Dies ist eine ziemlich neue moralischen Anspruch, den wir bekommen,", sagte Russell.

Gibt es bereits Systeme mit künstlicher Intelligenz und Roboter in Existenz, die dazu in der Lage die folgenden sind: Erfassung ihrer Umgebung bewegen und navigieren, planen Sie im Voraus oder Entscheidungen. "sie brauchen nur kombiniert werden", sagte Russell.

Schon jetzt hat die Defense Advanced Research Projekte Agency (DARPA), Zweiges des U.S. Department of Defense, aufgeladen mit zunehmendem Militärtechnologien, zwei Programme, die Besorgnis konnte Russell sagte. Die Agentur schnell leicht Autonomie (FLA) Projekt zielt auf kleine, unbemannte Fluggeräte entwickelt, um schnell in städtischen Gebieten zu reisen. Und die gemeinsame Operationen in verweigert Umwelt (CODE) Projekt beinhaltet die Entwicklung von Drohnen, die zusammen arbeiten könnten, zu finden und zu zerstören Ziele, "wie Wölfe in koordinierten Rudeln jagen", Jean-Charles Ledé, DARPA Programm-Manager, sagte in einer Erklärung.

Aktuelle humanitäre Völkerrecht befassen sich nicht die Entwicklung von tödlichen Roboter Waffen, Russell hingewiesen. Die Genfer Konvention von 1949, einer der mehrere Verträge, die humane Behandlung von Feinden in Kriegszeiten angibt erfordert, dass jede militärische Aktion drei Dinge erfüllen: militärische Notwendigkeit, Diskriminierung zwischen Soldaten und Zivilisten und wiegen des Wertes der ein militärisches Ziel gegen das Potenzial für Kollateralschäden.

Vertrag oder Wettrüsten?

Die Vereinten Nationen hat Gespräche über die Entwicklung der autonomen tödliche Waffen, und dieser Prozess kann dazu führen, ein neues internationales Abkommen Russell sagte. "Ich glaube, dass Verträge wirksam sein können," sagte er Leben Wissenschaft.

Zum Beispiel verboten ein Vertrag erfolgreich blendende Laserwaffen in 1995. "Es war eine Kombination von humanitären Ekel und der nüchternen praktische Wunsch zu vermeiden, dass Zehntausende von blinden Veteranen zu kümmern", sagte er.

Die Vereinigten Staaten, Großbritannien und Israel sind die drei Länder führt die Entwicklung des Roboterwaffen, und jede Nation glaubt, dass seine internen Prozesse für die Überprüfung der Waffen einen Vertrag unnötig, Russell schrieb.

Aber ohne einen Vertrag gibt es das Potenzial für eine Roboter-Wettrüsten zu entwickeln, Russell gewarnt. So ein Rennen würde nur aufhören "beim Ausführen an die Grenzen der Physik," wie die Reichweite, Geschwindigkeit und Nutzlast von autonomen Systemen.

Entwicklung der kleine Roboter, die in der Lage, Menschen zu töten ist nicht einfach, aber es ist machbar. "Mit 1 Gramm [0,03 Unzen] High-Explosive Ladung, können Sie ein Loch im Kopf einer Person mit einem Roboter Insekten-Größe blow" Russell sagte. "Ist dies die Welt wollen wir schaffen?" Wenn also, "Ich will nicht in dieser Welt zu leben," sagte er.

Andere Experten sind sich einig, dass die Menschheit muss vorsichtig sein bei der Entwicklung von autonomen Waffen. "In den Vereinigten Staaten, ist es sehr schwierig für die meisten AI-Wissenschaftler, Stellung zu beziehen" zu diesem Thema, weil US-Finanzierung "ist so gut wie alle KI-Forschung Militär," sagte Yoshua Bengio, Informatiker an der Universität von Montreal in Kanada, der einen eigenen Artikel in der gleichen Zeitschrift auf sogenannte deep Learning Co-Autor, eine Technologie zum Einsatz in AI.

Aber Bengio betonte auch die vielen Vorteile von AI, in der alles von Präzisionsmedizin auf die Fähigkeit, menschliche Sprache zu verstehen. "Das ist sehr spannend, denn es viele Anwendungsmöglichkeiten gibt", sagte er Leben Wissenschaft.

Folgen Sie Tanya Lewis auf Twitter . Folgen Sie uns @livescience, Facebook & Google +.