Ohne Claude Shannons Informationstheorie gäbe es kein internet

Es zeigte, wie man Kommunikation schneller machen und nehmen weniger Platz auf der Festplatte, wodurch das Internet möglich

Diese Gleichung wurde 1949 Buch The Mathematical Theory of Communication, Co-geschrieben von Claude Shannon und Warren Weaver veröffentlicht. Die elegante Art zu arbeiten, wie effizient ein Code sein könnte "Informationen" aus einer vage Wort im Zusammenhang mit wie viel jemand etwas zu einer präzisen mathematischen Einheit, die gemessen werden konnte kannte, stellte sich, manipuliert und übertragen. Es war der Beginn der Wissenschaft der "Informationstheorie", eine Reihe von Ideen, die uns erlaubt hat, Internet, digitale Computer und TK-Anlagen zu bauen. Wenn jemand über die Informations-Revolution der letzten Jahrzehnte spricht, ist es Shannons Idee von Informationen, die sie reden.

Claude Shannon war ein Mathematiker und Elektronik-Ingenieur arbeitet bei den Bell Labs in den USA Mitte des 20. Jahrhunderts. Sein Arbeitsplatz war der gefeierte Forschung und Entwicklung arm von der Bell Telephone Company, die USA die wichtigsten Anbieter von Telefondiensten bis in die 1980er, wann wurde es wegen seiner Monopolstellung abgewrackt. Während des zweiten Weltkrieges arbeitete Shannon an Codes und Methoden der Nachrichtenversand effizient und sicher über große Entfernungen, Ideen, die die Samen für seine Informationstheorie wurde.

Vor der Informationstheorie, Fernkommunikation erfolgte mit analogen Signalen. Senden eine Nachricht beteiligt verwandelte sie in unterschiedliche Impulse der Spannung längs eines Drahtes, könnte die am anderen Ende gemessen und interpretiert zurück in Worte. Dies ist im Allgemeinen gut für kurze Strecken, aber wenn Sie etwas über einen Ozean senden möchten, wird es unbrauchbar. Jeder Meter, das ein analoges elektrisches Signal an einem Draht zu reisen, es wird schwächer und leidet mehr von zufälligen Schwankungen, bekannt als Rauschen in den Materialien um ihn herum. Steigern Sie könnte das Signal am Anfang, natürlich, aber dies wird die unerwünschte Wirkung steigern auch den Lärm haben.

Informationstheorie dazu beigetragen, um dieses Problem zu überwinden. Shannon definiert, die Informationseinheiten, die kleinsten Stücke, die alle weiter, geteilt werden können, in was er "Bits" (kurz für Binary Digit) nannte, die Saiten, von denen verwendet werden können, um eine Nachricht zu verschlüsseln. Die am weitesten verbreitete digitale Code in der modernen Elektronik basiert auf Bits, die jeweils nur einen der beiden Werte haben können: 0 oder 1.

Diese einfache Idee verbessert sofort die Qualität der Kommunikation. Konvertieren Sie Ihre Nachricht, Buchstabe für Buchstabe, in einen Code aus 0en und 1en gemacht, dann senden Sie diese lange Zeichenfolge Ziffern auf einem Draht – jeder vertreten durch ein kurzes Niederspannungs-Signal 0 und jeden 1, vertreten durch einen kurzen Ausbruch von Hochspannung. Diese Signale, natürlich die gleichen Probleme wie ein analoges Signal, nämlich Schwächung und Lärm leiden. Aber das digitale Signal hat einen Vorteil: die 0en und 1en sind solche offensichtlich unterschiedliche Zustände, dass auch nach der Verschlechterung, Originalzustand weit unten den Draht rekonstruiert werden kann. Eine weitere Möglichkeit, die digitale Nachricht sauber zu halten ist zu lesen, mit elektronischen Geräten in Abständen entlang der Strecke und eine saubere Wiederholung zu senden.

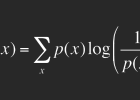

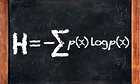

Shannon zeigte die wahre Stärke dieser Bits jedoch, indem man sie in einen mathematischen Rahmen. Seine Gleichung definiert eine Menge H, die Shannon-Entropie genannt und kann als ein Maß für die Informationen in einer Nachricht, gemessen in Bit betrachtet werden.

In einer Nachricht, die Wahrscheinlichkeit für ein bestimmtes Symbol (vertreten durch "X") drehen wird oben durch p(x) bezeichnet. Der rechten Seite der Gleichung oben fasst die Wahrscheinlichkeiten für die gesamte Palette von Symbolen, die in einer Nachricht, gewichtet nach der Anzahl der Bits, die erforderlich, um diesen Wert von x, eine Bezeichnung logp(x) darzustellen auftauchen könnte. (Logarithmus ist der umgekehrte Prozess etwas in eine Potenz zu erhöhen – wir sagen, dass der Logarithmus von 1000 bis 10 – schriftliches Protokoll10(1000)-base 3, weil 103= 1000.)

Eine Münze zu werfen, zum Beispiel hat zwei mögliche Ergebnisse (oder Symbole) – X könnte sein Kopf oder Zahl. Jeder Ausgang hat eine 50 % Wahrscheinlichkeit des Eintretens und p(heads) und p(tails) sind in diesem Fall jede ½. Shannons Theorie nutzt base 2 für seine Logarithmen und melden Sie sich2(½) ist -1. Das gibt uns eine total Informationsgehalt in spiegeln eine Münze, einen Wert für H von 1 Bit. Nach Abschluss eine Münze zu werfen haben wir ein Bit Information gewonnen oder vielmehr unsere Unsicherheit durch ein Bit reduziert.

Ein einzelnes Zeichen ein Alphabet von 27 entnommen hat rund 4,76 Bits von Informationen – mit anderen Worten melden2(1/27) – weil jeder Charakter ist oder keinem bestimmten Buchstaben dieses Alphabets ist. Da gibt es 27 dieser binären Möglichkeiten, ist die Wahrscheinlichkeit der einzelnen 1/27. Dies ist eine grundlegende Beschreibung eines grundlegenden englischen Alphabets (26 Zeichen und ein Leerzeichen), wenn jedes Zeichen gleich wahrscheinlich, in einer Nachricht zu machen war. Durch diese Berechnung brauchen Nachrichten in englischer Sprache Bandbreite für Speicherung oder Übertragung gleich der Anzahl der Zeichen multipliziert mit 4,76.

Aber wir wissen, dass jedes Zeichen in englischer Sprache, ebenso nicht angezeigt wird. Ein "u" in der Regel folgt eine "Q" und "e" ist häufiger als "Z". Diese statistischen Angaben berücksichtigen und es ist möglich, die H-Wert für englische Zeichen auf weniger als ein Bit zu reduzieren. Das ist nützlich, wenn Sie möchten Comms beschleunigen oder nehmen weniger Platz auf der Festplatte.

Informationstheorie wurde geschaffen, um praktische Möglichkeiten, um bessere und effizientere Codes und feststellen, dass die Grenzen auf wie schnelle Computer digitale Signale verarbeiten konnte zu finden. Jedes Stück von digitalen Informationen ist das Ergebnis von Codes, die wurden geprüft und verbessert mit Shannons Gleichung. Es hat die mathematische Untermauerung für erhöhte Datenspeicherung und Kompression – Zip-Dateien, MP3s und JPGs könnten ohne sie nicht existieren. Und keiner von diesen HD-Videos im Internet ohne Shannons Mathematik möglich gewesen wäre.